Nova Délhi, capital da Índia, tornou-se nesta semana o epicentro de uma das discussões mais importantes do século 21. Não estamos falando apenas de tecnologia. Estamos falando de poder, influência global, modelos de desenvolvimento e, fundamentalmente, sobre quem vai definir as regras do jogo em um mundo cada vez mais comandado por algoritmos e Inteligência Artificial.

A Cúpula de Impacto da Inteligência Artificial, em sua quarta edição, reuniu 20 chefes de Estado, 45 delegações ministeriais e os CEOs das empresas mais poderosas do setor tecnológico. Entre os presentes estão o presidente brasileiro Luiz Inácio Lula da Silva, o primeiro-ministro indiano Narendra Modi, o presidente francês Emmanuel Macron, Sam Altman da OpenAI, Sundar Pichai do Google e Dario Amodei da Anthropic.

Mas esta não é uma reunião protocolar onde todos sorriem para as câmeras e assinam documentos genéricos. É um campo de batalha diplomático onde visões radicalmente diferentes sobre o futuro da IA estão em confronto direto.

De um lado, defensores da regulação rigorosa, preocupados com a segurança, a privacidade e os impactos sociais. Do outro, aceleracionistas que veem qualquer regulamentação como obstáculo ao progresso e à competitividade econômica.

E no meio disso tudo, países emergentes como Brasil e Índia tentam navegar entre essas posições extremas, buscando caminhos próprios que atendam suas realidades específicas. É política de poder disfarçada de conversa sobre tecnologia. E as decisões tomadas, ou a falta delas, vão moldar não apenas como usamos a IA, mas como vivemos nas próximas décadas.

Vamos destrinchar essa trama complexa, entender as posições de cada ator principal e descobrir o que realmente está em jogo quando líderes mundiais e bilionários da tecnologia se reúnem para falar sobre a Inteligência Artificial.

A Primeira Cúpula do Sul Global: Por que o local importa?

Este é um detalhe que pode parecer menor, mas é absolutamente crucial para entender a dinâmica deste encontro. Pela primeira vez desde que essas cúpulas de IA começaram em 2023, o evento acontece em um país em desenvolvimento, no chamado Sul Global.

As três edições anteriores foram todas em países desenvolvidos. A primeira em Bletchley Park, na Inglaterra, em 2023, foi chamada de Cúpula de Segurança em IA e focou quase exclusivamente nos riscos da tecnologia. A segunda aconteceu em Seul, na Coreia do Sul, em 2024. A terceira foi em Paris, França, em 2025, batizada de Cúpula de Ação em IA, que começou a incorporar aspectos econômicos mas manteve a regulação como prioridade.

Agora, em 2026, a Índia assume como anfitriã e muda completamente o tom. O próprio nome escolhido já sinaliza a mudança de foco: Cúpula de Impacto da Inteligência Artificial. Não é sobre segurança primeiro, não é sobre regulação antes de tudo. É sobre o impacto econômico, social e ambiental. É sobre as oportunidades e o crescimento.

Por que isso importa? Porque países em desenvolvimento têm preocupações fundamentalmente diferentes de nações ricas quando se trata de IA. Para um país como França ou Reino Unido, que já tem economias avançadas, infraestrutura digital robusta e empresas de tecnologia competitivas, faz sentido focar em regulação para proteger cidadãos e garantir que a tecnologia seja usada de forma ética.

Mas para países como Índia ou Brasil, a prioridade é diferente. Há uma urgência em usar a IA para impulsionar o desenvolvimento econômico, criar empregos, melhorar serviços públicos e não ficar ainda mais para trás na corrida tecnológica global. Regular demais, cedo demais, pode significar perder oportunidades críticas de crescimento.

Como Fabro Steibel, diretor-executivo do ITS, colocou de forma bastante direta: “Focar apenas em regulação é chutar a escada do Sul Global, rejeitar a IA antes de sermos competitivos. Deixa a gente primeiro ter o que almoçar, para depois reclamar do excesso de sódio.”

É uma metáfora poderosa que captura perfeitamente a frustração de países emergentes com a narrativa dominante sobre a IA, que muitas vezes parece ignorar completamente suas realidades e necessidades específicas.

As Três Visões em Conflito: Europa, Estados Unidos e o Caminho Alternativo

Para entender a dinâmica desta cúpula, precisamos primeiro mapear as três grandes visões sobre como governar a Inteligência Artificial que estão em disputa.

A primeira é a abordagem europeia, representada principalmente pela União Europeia e sua Lei de IA. É uma visão fortemente regulatória, focada em riscos, proteção de dados pessoais, transparência algorítmica e responsabilização de empresas. A Europa vê a IA como algo que precisa ser controlado e domesticado antes que cause danos irreparáveis à sociedade.

Esta abordagem nasceu das experiências negativas com a tecnologia digital nas últimas décadas. Escândalos de privacidade, manipulação eleitoral através de redes sociais, desinformação massiva, discriminação algorítmica. Tudo isso levou a Europa a concluir que tecnologia sem regulação forte é perigosa, e que empresas privadas não podem ser confiadas para se autorregular.

A Lei da IA europeia, que entrou em vigor progressivamente a partir de 2024, é considerada a regulação mais abrangente do mundo sobre o tema. Classifica sistemas de IA em níveis de risco, proíbe completamente certos usos considerados muito perigosos, e impõe requisitos rigorosos de transparência e prestação de contas para sistemas de alto risco. Empresas que violam podem enfrentar multas de até 6% de seu faturamento global.

Na outra ponta do espectro está a visão americana sob Donald Trump. É uma abordagem radicalmente oposta, apostando em desregulamentação quase total como forma de impulsionar a inovação e garantir vantagem competitiva contra a China. O governo Trump vê a regulação como uma burocracia que sufoca a criatividade e permite que concorrentes, especialmente chineses, ganhem terreno.

Mais que isso, os Estados Unidos têm ameaçado explicitamente retaliar países que adotam regulações consideradas prejudiciais às grandes empresas de tecnologia americanas. É diplomacia agressiva disfarçada de política tecnológica. A mensagem é clara: se você regular nossas empresas de forma que não gostamos, haverá consequências econômicas e políticas.

E então há a tentativa de uma terceira via, representada principalmente pela Índia nesta cúpula. É uma abordagem que rejeita tanto a regulação pesada europeia quanto a desregulamentação americana. O foco está em democratizar acesso à tecnologia, desenvolver aplicações locais adaptadas às realidades específicas do país, e principalmente atrair investimentos para construir uma infraestrutura digital.

A Índia quer se posicionar como potência emergente de IA, oferecendo uma alternativa independente tanto do modelo chinês quanto do americano. É uma aposta ambiciosa que reconhece a importância da IA para o desenvolvimento, mas tenta encontrar um caminho próprio que não seja nem regulação sufocante nem liberalismo tecnológico sem freios.

A Posição Brasileira: Entre Europa e o Pragmatismo

E onde o Brasil se encaixa nesse xadrez geopolítico? A resposta é complicada e revela tensões internas sobre a melhor estratégia para o país.

Oficialmente, o governo brasileiro se alinha mais à posição europeia. Há uma ênfase forte em regulação, proteção de dados pessoais, combate à desinformação e preocupação com impactos sociais da IA. O presidente Lula representa essa linha na cúpula, defendendo uma abordagem cautelosa que prioriza segurança e direitos antes da velocidade de adoção.

Essa postura se reflete no PL 2.338/2023, o projeto de lei de IA que tramita na Câmara dos Deputados. É uma legislação inspirada claramente no modelo europeu, com classificação de riscos, requisitos de transparência e mecanismos de responsabilização.

A ministra da Gestão e Inovação, Esther Dweck, defendeu esta abordagem na cúpula, argumentando que é preciso avaliar consequências da disrupção tecnológica, incluindo concentração de riqueza e impactos sociais e ambientais.

Luciana Santos, ministra da Ciência e Tecnologia, reforçou que áreas sensíveis como dados pessoais, saúde, sistemas autônomos e proteção de crianças exigem atenção especial do Estado. Para ela, não se trata de olhar excessivamente voltado a riscos, mas de uma abordagem responsável e equilibrada.

Mas há vozes fortes dentro do Brasil questionando se essa não é uma estratégia equivocada que pode prejudicar o país. Fabro Steibel foi particularmente crítico, argumentando que o Brasil adotou uma narrativa excessivamente europeia de só enfocar riscos, sendo que o maior risco para o Brasil é justamente a não adoção da IA.

Ele propõe um caminho do meio, nem o modelo americano onde tudo pode, nem o europeu onde nada pode. É um eco da proposta indiana de terceira via, e sugere que há um debate interno no Brasil sobre qual estratégia realmente serve aos interesses nacionais.

O governo brasileiro tenta se defender dessa crítica argumentando que tem uma abordagem equilibrada. De um lado, riscos seriam tratados através da legislação regulatória. Do outro, oportunidades e incentivos estariam no Plano Brasileiro de Inteligência Artificial, com investimentos previstos de 23 bilhões de reais em quatro anos, incentivos fiscais e instrumentos de apoio à inovação.

Mas a questão permanece: é possível realmente equilibrar essas duas frentes, ou inevitavelmente uma vai dominar a outra? E mais importante, o Brasil tem os recursos e a capacidade institucional para competir globalmente em IA enquanto mantém uma estrutura regulatória rigorosa?

A Estratégia Indiana: Investimentos acima de Tudo

Enquanto o Brasil e a Europa falam muito sobre regulação, a Índia deixa claríssimo qual é sua prioridade número um: atrair investimentos para a infraestrutura de IA, especialmente data centers.

Os números são impressionantes. A expectativa do governo indiano é atrair mais de 200 bilhões de dólares em investimentos em IA ao longo de apenas dois anos. É mais que o PIB de muitos países inteiros. O ministro da Tecnologia, Ashwini Vaishnaw, anunciou isso publicamente na cúpula, deixando claro que essa é a métrica de sucesso pela qual a Índia quer ser julgada.

E o país está disposto a fazer o que for necessário para conseguir esse dinheiro. Está oferecendo isenção fiscal por vinte anos para empresas estrangeiras que prestarem serviços globais de data center no território indiano. Também concedeu outros incentivos e flexibilizou regras de uso da terra especificamente para o setor de tecnologia.

O grupo Adani, próximo ao primeiro-ministro Narendra Modi, anunciou sozinho um investimento de 100 bilhões de dólares até 2035 em data centers. É uma aposta gigantesca que sinaliza o nível de comprometimento do setor privado indiano com essa visão.

A Índia tem alguns trunfos únicos que facilitam essa estratégia. O país possui o programa de identidade digital Aadhar, que tem dados de mais de um bilhão de pessoas. Tem também uma interface unificada de pagamentos que facilita transações digitais em escala. E está desenvolvendo sistemas de intercâmbio de dados para disseminar aplicativos de IA desenvolvidos localmente.

Um objetivo particular é criar modelos de linguagem nas dezenas de idiomas falados no país, algo que empresas americanas ou chinesas provavelmente nunca farão. É uma oportunidade de desenvolver tecnologia que realmente serve à população local, não apenas importar soluções estrangeiras.

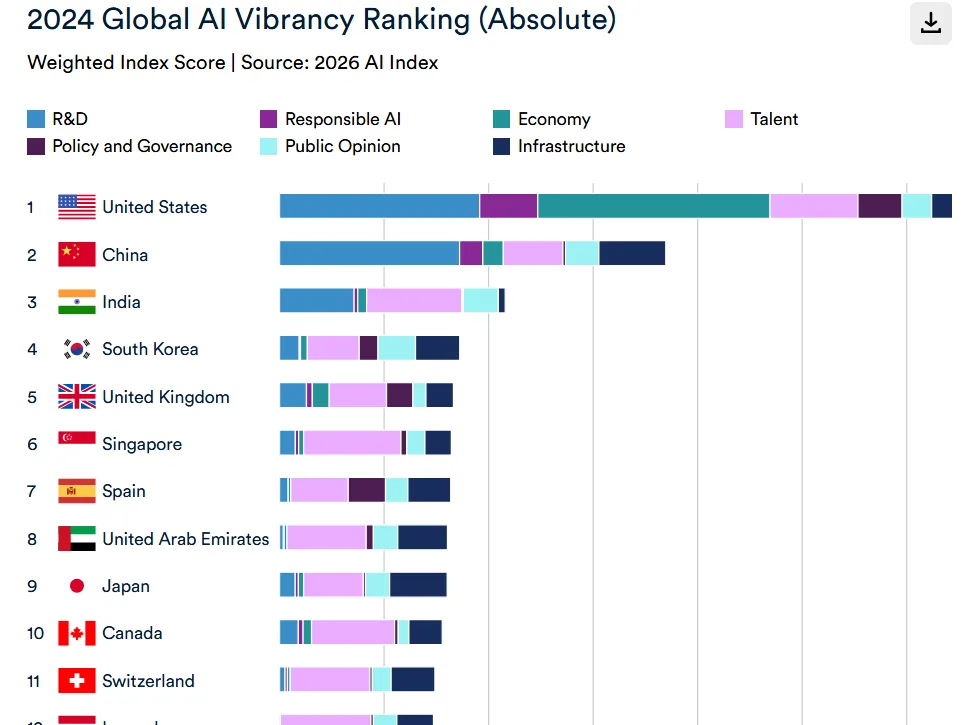

O país já ocupa terceiro lugar no ranking global de competitividade em IA do Institute for Human-Centered AI da Universidade Stanford, atrás apenas de China e Estados Unidos, mas à frente de Reino Unido e Japão. É uma posição impressionante para um país em desenvolvimento, e a Índia quer consolidar e expandir essa liderança.

Abhishek Singh, presidente da agência governamental IndiaAI, disse à revista The Economist que o país quer ser a capital mundial da adoção da tecnologia. O foco não é necessariamente inventar a IA mais avançada, mas ser o lugar onde ela é mais amplamente usada e integrada à vida cotidiana.

Mas há críticos dessa abordagem. Astha Kapoor, cofundadora do Instituto Aapti, argumenta que a democratização de acesso na visão indiana significa ampliar o uso, mas não necessariamente assegurar que direitos das pessoas sejam respeitados ou adotar medidas de transparência. É uso em larga escala sem proteções adequadas.

E há uma contradição interessante na posição indiana. O país adota mão pesada na moderação de conteúdo na internet, incluindo conteúdo gerado por IA. Poucos dias antes da cúpula, o governo divulgou novas regras obrigando plataformas a retirarem ou rotularem conteúdos sintéticos ou ilegais em três horas após notificação oficial. Está considerando impor restrições de idade no acesso a redes sociais, seguindo Austrália e Espanha.

Então, em algumas áreas, a Índia é extremamente regulatória e controladora. Mas em IA especificamente, a postura é de mínima intervenção para maximizar investimentos. É uma abordagem seletiva que prioriza crescimento econômico sobre outras considerações.

A Rivalidade que não se esconde: Quando CEOs se recusam a dar as mãos

Em meio a todas essas discussões geopolíticas e estratégicas, houve um momento que capturou perfeitamente as tensões do setor: Sam Altman da OpenAI e Dario Amodei da Anthropic se recusaram abertamente a dar as mãos para uma foto oficial durante a cúpula.

Pode parecer uma bobagem, uma questão de protocolo ou ego. Mas na verdade é um símbolo perfeito das guerras comerciais e ideológicas que estão acontecendo no coração da indústria de IA.

A cena aconteceu durante uma foto oficial com Sundar Pichai do Google e o primeiro-ministro indiano Narendra Modi. Todos os outros estavam de mãos dadas, em pose tradicional de unidade e cooperação. Mas quando chegou a vez de Altman e Amodei, ambos simplesmente se recusaram. Ficaram de braços cruzados ou ao lado do corpo, deixando um espaço visível entre eles.

Para entender por que isso aconteceu, precisamos voltar a 2021. Naquele ano, Dario Amodei era vice-presidente de pesquisa na OpenAI, trabalhando diretamente com Sam Altman. Mas ele e vários outros executivos seniores deixaram a empresa em uma saída dramática para fundar a Anthropic.

O motivo alegado foi divergência fundamental sobre a segurança em IA. Amodei e seu grupo achavam que a OpenAI estava se tornando excessivamente focada em comercialização e crescimento rápido, negligenciando questões críticas de segurança. Queriam uma empresa que colocasse segurança e ética absolutamente em primeiro lugar, mesmo que isso significasse desenvolvimento mais lento.

Meses depois dessa saída, a OpenAI lançou o ChatGPT, que se tornou o aplicativo de crescimento mais rápido da história, alcançando 100 milhões de usuários em apenas dois meses. Foi um sucesso comercial absolutamente estrondoso que validou completamente a estratégia de Altman de priorizar velocidade e escala.

Enquanto isso, a Anthropic lançou o Claude, seu próprio chatbot de IA. É tecnicamente impressionante e em alguns aspectos superior ao ChatGPT, mas nunca alcançou a mesma penetração de mercado ou reconhecimento de marca. É usado principalmente por empresas e profissionais técnicos, não pelo público geral.

A rivalidade entre as duas empresas se intensificou recentemente com uma troca pública de farpas durante o Super Bowl. A Anthropic veiculou comerciais que ironizavam chatbots manipuladores que criam vínculos artificiais com usuários para depois vender produtos. O anúncio terminava com a frase provocativa: “Anúncios estão chegando à IA. Mas não ao Claude.”

Era uma crítica direta à decisão da OpenAI de começar a incluir publicidade no ChatGPT. “A Anthropic se posiciona como a alternativa ética que nunca vai vender seus usuários para anunciantes”.

A reação de Altman foi imediata e afiada. Ele chamou os comerciais de engraçados mas desonestos, e contra-atacou com dados. Disse que mais texanos usam o ChatGPT gratuitamente do que o total de americanos que utilizam o Claude. Foi uma forma brutal de dizer: vocês podem falar de ética o quanto quiserem, mas nós vencemos no mercado.

First, the good part of the Anthropic ads: they are funny, and I laughed.

— Sam Altman (@sama) February 4, 2026

But I wonder why Anthropic would go for something so clearly dishonest. Our most important principle for ads says that we won’t do exactly this; we would obviously never run ads in the way Anthropic…

Greg Brockman, presidente da OpenAI, foi ainda mais longe, questionando publicamente se a Anthropic realmente nunca venderia dados ou atenção de usuários a anunciantes. Era basicamente chamar a promessa da concorrente de marketing vazio.

Dario Amodei optou por não responder diretamente, mantendo a postura de superioridade moral da Anthropic. Mas o silêncio também pode ser interpretado como falta de resposta convincente.

Essa rivalidade vai muito além de personalidades. Representa duas visões fundamentalmente diferentes sobre como desenvolver e comercializar IA. De um lado, a abordagem da OpenAI: mover rápido, quebrar coisas, priorizar adoção em massa, monetizar agressivamente.

Do outro, a filosofia da Anthropic: desenvolvimento cauteloso, foco em segurança, mercado corporativo em vez de consumidor geral, recusa de modelos de negócio baseados em publicidade.

E no meio dessa briga estão Google e outras gigantes, cada uma com sua própria estratégia e vantagens. O Google tem o modelo Gemini e infraestrutura de computação em nuvem incomparável. A Amazon é o principal provedor de nuvem da Anthropic. A Microsoft detém participação significativa na OpenAI.

É um emaranhado de alianças, rivalidades e dependências que torna impossível entender a indústria de IA sem considerar essas dinâmicas comerciais e pessoais.

O que Realmente está em Jogo: Além da Tecnologia

Voltando ao contexto maior da cúpula, é importante entender que essas discussões sobre IA não são realmente sobre tecnologia. São sobre poder, controle e o futuro da ordem mundial.

Quando a Europa defende regulação rigorosa, está tentando proteger seu modelo social de bem-estar, seus padrões de privacidade e sua autonomia estratégica contra dominação de empresas americanas e chinesas. É uma tentativa de manter relevância e influência em um mundo onde poder cada vez mais vem de capacidade tecnológica.

Quando Estados Unidos sob Trump rejeita a regulação, não é apenas sobre deixar empresas inovarem livremente. É sobre manter a hegemonia tecnológica global como fundamento do poder geopolítico. Se a China ou outros países avançarem mais rápido em IA, isso tem implicações militares, econômicas e políticas profundas.

Quando a Índia busca sua terceira via, está tentando posicionar-se como potência emergente que não será nem vassalo americano nem subordinado chinês. É uma aposta em autonomia estratégica através da capacidade tecnológica própria.

E quando o Brasil hesita entre diferentes abordagens, reflete confusão mais profunda sobre a identidade e a estratégia nacional. Somos do Sul Global que deve priorizar o desenvolvimento? Somos uma democracia que deve valorizar direitos e regulação? Somos uma economia emergente que precisa de investimentos estrangeiros? A resposta provavelmente é que somos tudo isso, o que torna a formulação de uma política coerente extremamente difícil.

As discussões na cúpula sobre governança de IA tocam em questões fundamentais. Quem vai definir os padrões técnicos que o resto do mundo adota? Quem vai estabelecer normas éticas sobre o que IA pode ou não fazer? Quem vai controlar a infraestrutura física, os data centers e redes que fazem a IA funcionar? Quem vai possuir os dados que alimentam os sistemas de IA?

Essas não são questões técnicas. São questões de puro poder. E a razão pela qual esta cúpula é tão importante, mesmo que não produza resultados concretos imediatos, é que estabelece posições e alianças que vão moldar essas batalhas futuras.

Olhando para Frente: O que vem depois desta Cúpula

A Cúpula de Impacto da IA na Índia termina, líderes vão voltar para seus países, e a vida segue. Mas algumas tendências que ficaram evidentes aqui vão continuar se desenvolvendo.

A divisão entre abordagem europeia regulatória e americana desregulamentada vai se aprofundar. Os Estados Unidos sob o Governo Trump vão continuar pressionando contra a regulação e ameaçando retaliar. A Europa vai continuar refinando e expandindo suas regras. Empresas de tecnologia vão continuar tendo que navegar sobre essas exigências contraditórias.

Países emergentes vão continuar tentando encontrar caminhos próprios que não sejam simplesmente cópia de modelos desenvolvidos em outros lugares. A Índia vai continuar sua estratégia de atrair investimentos enquanto mantém o controle sobre o conteúdo. O Brasil vai continuar oscilando entre influência europeia e pragmatismo de desenvolvimento.

A rivalidade entre a OpenAI e a Anthropic, e mais amplamente entre diferentes visões de como comercializar a IA, vai se intensificar. Veremos mais disputas públicas, mais acusações de hipocrisia, mais pressões por posição tanto em mercados quanto em narrativas públicas.

E fundamentalmente, a IA vai continuar avançando a uma velocidade que torna qualquer governança reativa sempre correndo atrás. Quando as regulações forem implementadas, a tecnologia já evoluiu para algo diferente que as regras não contemplam adequadamente.

Isso não significa que a governança é inútil. Significa que precisa ser adaptativa, flexível, capaz de evoluir tão rápido quanto a tecnologia. E isso é extremamente difícil para instituições governamentais que operam em escalas de tempo de anos ou décadas, não meses.

A próxima cúpula provavelmente será em 2027, possivelmente em um país africano para continuar a rotação pelo Sul Global. As discussões vão refletir o estado da IA naquele momento, que provavelmente será significativamente diferente de hoje. Novos avanços técnicos, novos casos de uso, novos problemas e talvez novas oportunidades.

A Importância de estar na Mesa

No final, a mensagem mais importante desta cúpula pode ser simplesmente esta: estar na mesa onde decisões são discutidas, mesmo que não tomadas, é crucial.

Para o Brasil, participar ativamente dessas discussões globais sobre a IA é questão de soberania estratégica. As decisões sobre como a IA é governada globalmente vão afetar profundamente o país, independentemente de estarmos ou não presentes quando são tomadas. Melhor estar lá, articulando interesses e construindo alianças.

Para a Índia, sediar esta cúpula é uma forma de sinalizar ambições de liderança tecnológica e relevância geopolítica crescente. É soft power em ação, mostrando ao mundo que a Índia não é apenas um mercado emergente, mas um player que molda o futuro.

Para as empresas como a OpenAI e a Anthropic, presença nesses eventos é tanto sobre influenciar política quanto sobre marketing. Ser visto ao lado de presidentes e primeiros-ministros confere legitimidade e importância. E ter acesso direto a formuladores de política permite moldar regulações de formas favoráveis.

E para os cidadãos comuns, que somos todos nós, esses eventos distantes em capitais estrangeiras importam porque as decisões e direções estabelecidas lá eventualmente afetam nossas vidas cotidianas. Como nossos dados são usados, sobre as mudanças no tipo de trabalho, que serviços públicos temos acesso, tudo isso é moldado por essas discussões de alto nível sobre a governança de IA.

A Cúpula de Impacto da IA na Índia não vai resolver todas as questões sobre como humanidade deve lidar com esta tecnologia transformadora. Não vai criar consenso global onde existem interesses conflitantes. Não vai eliminar tensões entre desenvolvimento e segurança, entre inovação e proteção.

Mas vai continuar a conversa. Vai estabelecer pontos de referência. Vai criar espaços de diálogo. E numa área tão complexa e de mudança tão rápida quanto a IA, isso já é valioso.

O futuro da Inteligência Artificial está sendo decidido agora, em discussões como esta. E embora seja impossível prever exatamente como vai se desenrolar, uma coisa é certa: os países e atores que se engajam ativamente nessas discussões terão muito mais influência sobre o resultado do que aqueles que ficam de fora apenas assistindo.