Escrever código sempre foi considerado a parte difícil do desenvolvimento de software. Revisar o código dos outros, porém, é onde muita coisa dá errado. É um processo lento, sujeito a distrações e que, na prática, frequentemente resulta numa leitura superficial de pull requests que deveriam ser analisados com atenção.

A Anthropic lançou em 9 de março de 2026 o Claude Code Review, uma ferramenta de revisão de código alimentada por inteligência artificial integrada ao Claude Code. O recurso está disponível, inicialmente em modo de pesquisa, para assinantes dos planos Claude for Teams e Claude for Enterprise.

A proposta parece lógica à primeira vista: se o Claude Code já está sendo usado para escrever código em larga escala, por que não usá-lo também para revisar o que foi escrito?

Mas a resposta da comunidade de desenvolvedores não ficou exatamente entusiasmada. O preço da ferramenta, a questão do impacto nos papéis dos engenheiros seniores e até a estranheza conceitual de pedir a uma IA que revise o código que ela mesma ajudou a criar são os pontos que estão no centro do debate.

Leia Também: O Preço do Petróleo Ameaça o Futuro da Inteligência Artificial

Por Que a Anthropic Criou esta Ferramenta?

É preciso entender o problema que a ferramenta tenta resolver. De acordo com observações recentes do setor, a velocidade de geração de código acelerou tanto que ultrapassou a capacidade humana de revisá-lo.

A própria Anthropic reportou um aumento de 200% na produção de código de suas equipes de engenharia ao longo do último ano.

Esse crescimento criou um gargalo que está se tornando um dos maiores riscos no desenvolvimento de software moderno. Com tantos pull requests na fila para revisão, os engenheiros passaram a fazer leituras rápidas em vez de análises profundas. E nessa corrida, bugs passam despercebidos.

Para entender o termo, um pull request (ou PR, pedido de integração em português) é o mecanismo pelo qual um desenvolvedor propõe alterações em uma base de código.

Antes de essas mudanças serem incorporadas ao produto final, elas precisam ser revisadas e aprovadas, geralmente por outro engenheiro da equipe. É esse processo que o Claude Code Review pretende automatizar e tornar mais robusto.

“Temos visto um grande crescimento no Claude Code, especialmente dentro das empresas, e uma das perguntas que continuamos recebendo dos líderes corporativos é: agora que o Claude Code está gerando um monte de pull requests, como posso garantir que eles sejam revisados de maneira eficiente?”, disse Cat Wu, chefe de produto da Anthropic, ao TechCrunch.

A resposta foi o Code Review.

Como Funciona o Claude Code Review na Prática

A arquitetura por trás da ferramenta é o que a diferencia dos revisores de código mais simples já existentes no mercado. Em vez de um único modelo analisando o código de forma linear, o Claude Code Review usa o que a Anthropic chama de arquitetura multiagente.

Quando um pull request é aberto, o sistema envia automaticamente uma equipe de agentes de IA para examinar o código. Esses agentes trabalham em paralelo, analisando o projeto sob diferentes perspectivas.

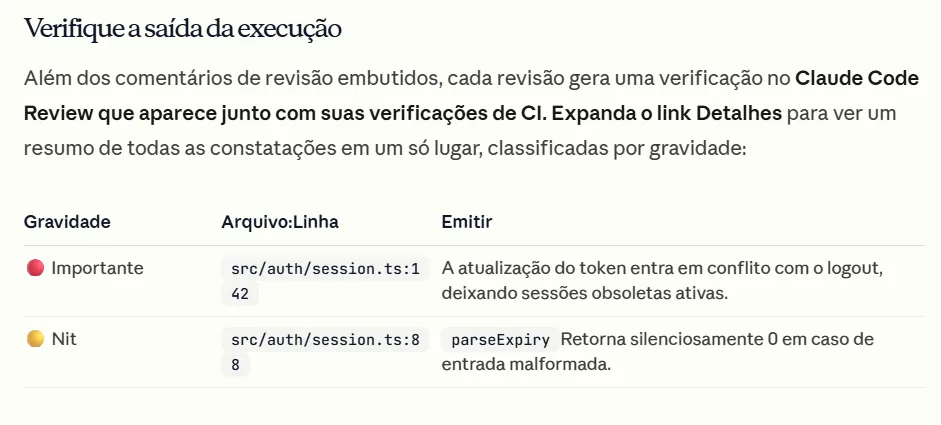

Depois dessa etapa, os resultados são consolidados em um relatório único. O sistema gera um comentário geral com uma visão ampla da revisão e anotações diretamente nas linhas de código, apontando possíveis problemas.

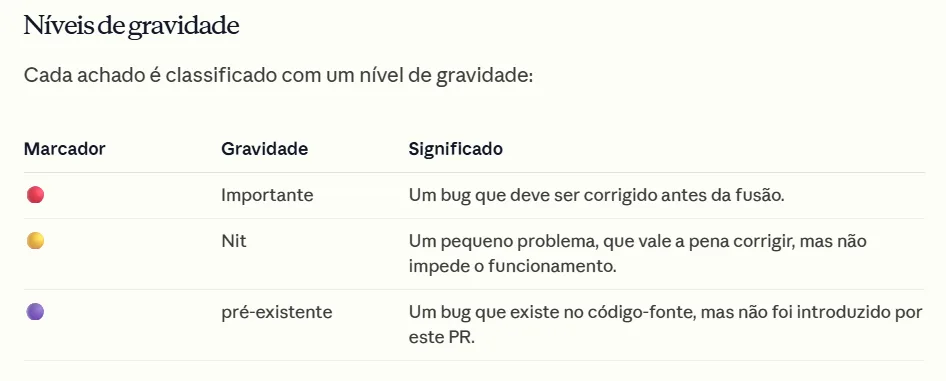

Os erros encontrados são classificados por gravidade para ajudar os desenvolvedores a priorizar as correções.

Em termos práticos, o conceito de arquitetura multiagente (sistema de múltiplos agentes) significa que diferentes instâncias especializadas da IA analisam o mesmo problema ao mesmo tempo, cada uma focando em um aspecto específico.

Um agente pode olhar para falhas de segurança, outro para erros de lógica, um terceiro para problemas de performance. O consenso entre esses agentes é o que compõe a revisão final.

Durante os testes internos da Anthropic, o sistema detectou um erro de um dos engenheiros seniores da empresa. Uma única alteração em uma linha de código desativava acidentalmente a verificação de autenticação de um serviço crítico.

O Code Review identificou a falha em questão de segundos, algo que três revisores humanos tinham deixado passar na pressa de fechar a tarefa.

Além da análise em paralelo, o sistema tem uma etapa de verificação que tenta refutar cada problema encontrado antes de publicar os resultados. Isso funciona como um filtro de falsos positivos, ou seja, um mecanismo para evitar alertas sobre problemas que não existem de fato.

Os problemas identificados são priorizados por cores: vermelho, amarelo e roxo, por ordem de severidade. O sistema também explica o raciocínio por trás de cada identificação, tornando mais fácil para o desenvolvedor entender e decidir o que corrigir primeiro.

De acordo com testes da própria Anthropic, uma revisão completa costuma levar cerca de 20 minutos.

Os Números Internos que a Anthropic Apresentou

Para justificar o lançamento, a Anthropic compartilhou os resultados de um período extenso de testes internos, nos quais aplicou o Code Review em todos os pull requests gerados pelas suas próprias equipes de engenharia.

Antes da implementação da ferramenta, apenas 16% dos pull requests internos recebiam comentários considerados substantivos por parte dos revisores humanos.

Após a integração do Code Review, esse número subiu para 54%. Para mudanças de grande escala, com mais de 1.000 linhas de código, o sistema identificou problemas em 84% das submissões, com uma média de 7 problemas por revisão.

São números relevantes. Mas analistas já apontam que dados de testes internos, feitos pela própria empresa em seus próprios projetos, têm limitações óbvias. A verdadeira prova de fogo será a performance em ambientes externos, com bases de código diversas e equipes com padrões de desenvolvimento diferentes.

Empresas como Uber, Salesforce e Accenture já utilizam o Claude Code e foram citadas pela Anthropic como parte do público-alvo do novo recurso.

O Preço que Dividiu a Comunidade

Se a funcionalidade da ferramenta gerou curiosidade, o preço gerou polêmica. A Anthropic estima que cada revisão custe, em média, entre US$ 15 e US$ 25, o equivalente a aproximadamente R$ 82 e R$ 137 pelas cotações atuais.

O valor é cobrado por uso de tokens e varia conforme a complexidade e o tamanho do pull request analisado.

O token é a unidade de processamento usada pelos modelos de linguagem. Quanto mais texto o modelo precisa ler e gerar para completar uma tarefa, mais tokens são consumidos e maior é o custo.

A reação nas redes sociais foi imediata. Jean PD Meijer, engenheiro de software e fundador de uma startup, foi direto ao ponto em uma publicação no X: “Como é possível que a revisão de código do Claude custe de US$ 15 a US$ 25 por PR? Uma revisão custa basicamente o preço de uma assinatura ilimitada da maioria dos aplicativos de revisão de código.”

O argumento tem peso. Ferramentas dedicadas de revisão de código, como o CodeAnt AI, oferecem revisões ilimitadas por uma taxa fixa de US$ 24 por usuário por mês, ou cerca de R$ 131 mensais. No modelo da Anthropic, essa mesma quantia pagaria por, no máximo, uma ou duas revisões individuais.

Karan Kendre, desenvolvedor de uma startup de design, foi além e questionou a própria lógica do produto: “Se o Claude Code é capaz de escrever código limpo em uma base de código, por que ele não consegue escrevê-lo desde o início? Porque eles querem cobrar de 15 a 25 dólares por revisão, além da assinatura do Claude Code.”

A Anthropic reconheceu o custo elevado desde o início. A empresa declarou que a ferramenta “é mais cara do que soluções mais leves, como o Claude Code GitHub Action”, pois “otimiza para profundidade” em vez de velocidade.

Cat Wu confirmou que o produto é “uma experiência premium” voltada para os casos em que a qualidade da revisão justifica o investimento.

A Polêmica Sobre o Papel dos Engenheiros Seniores

A discussão sobre o preço levou naturalmente a uma questão mais profunda. Um desenvolvedor que usa o pseudônimo @TukiFromKL e está construindo uma startup de IA publicou no X: “Claude acabou de colocar um preço no seu desenvolvedor sênior. US$ 15 a US$ 25 por revisão de código. Agentes de IA que começam instantaneamente assim que você abre um PR. As pessoas que protegem seus salários de US$ 200 mil controlando as revisões de código estão prestes a ter um trimestre muito ruim.”

A frase resume uma tensão que cresce há meses no mercado de tecnologia. A revisão de código é uma das atribuições mais valorizadas dos engenheiros seniores, profissionais experientes que não apenas escrevem código, mas garantem a qualidade técnica do que a equipe inteira produz.

Se uma IA começa a executar essa função de forma automática, o que muda no papel desses profissionais?

Wu reconheceu indiretamente essa questão ao afirmar que os líderes de desenvolvimento podem ativar o Code Review para funcionar como padrão para todos os engenheiros da equipe, o que significa que o recurso pode ser ativado de cima para baixo, sem necessariamente passar pela aprovação dos revisores humanos que ele pretende auxiliar ou substituir.

Essa não é uma preocupação trivial. A revisão de código funciona como um sistema de controle de qualidade humano dentro do desenvolvimento de software.

É o momento em que um engenheiro mais experiente compartilha conhecimento, detecta padrões problemáticos antes que se tornem hábito e garante que o código que entra na base de produção seja seguro e compreensível.

Automatizar isso com IA muda não apenas o processo, mas a dinâmica de aprendizado dentro das equipes.

Mas Será que a IA Consegue Revisar Código que Ela Mesma Escreveu?

Existe uma questão conceitual no centro de tudo isso que merece atenção. À medida que os desenvolvedores usam o Cursor, o GitHub Copilot e o Claude Code para escrever proporções crescentes do código em produção, o revisor e o autor começam a compartilhar os mesmos modelos subjacentes, os mesmos dados de treinamento e os mesmos pontos cegos sistemáticos.

Uma análise da empresa Builder.io resumiu o problema de forma direta: “Pedir a uma IA que avalie seu próprio trabalho é um pouco como contratar um corretor ortográfico para editar um romance.”

A Anthropic tentou mitigar esse problema com a arquitetura multiagente, justamente para que diferentes instâncias analisem o código por ângulos distintos. Mas críticos apontam que agentes distintos que compartilham o mesmo modelo base podem ter limitações em comum que nenhum deles consegue enxergar.

A questão mais importante e mais incômoda sobre o Claude Code Review é exatamente essa: se as ferramentas de IA escreveram o código, as ferramentas de IA conseguem revisá-lo com eficácia?

Não há uma resposta definitiva ainda. O período de pesquisa prévia que a Anthropic instaurou existe exatamente para explorar essa questão em ambientes reais.

Há Quem Defenda a Ferramenta

Nem todo desenvolvedor reagiu com ceticismo. Thariq Shihipar, engenheiro da Anthropic que trabalha no Claude Code, respondeu às críticas no X afirmando que o Code Review “usa muito mais poder computacional e tende a detectar bugs mais difíceis” do que soluções mais simples.

Para sustentar esse argumento, a empresa aponta para dados internos que mostram que o sistema é capaz de identificar bugs que revisores humanos deixaram passar, especialmente em mudanças grandes e complexas.

A promessa central é que o investimento na ferramenta se paga quando ela detecta um bug crítico que teria chegado ao ambiente de produção.

Há ainda outro ângulo. A receita anualizada do Claude Code já ultrapassou US$ 2,5 bilhões desde o lançamento, e o número de assinaturas corporativas quadruplicou desde o início do ano.

Para equipes que já usam o Claude Code intensivamente e que estão vendo o volume de pull requests crescer mês a mês, adicionar uma camada automatizada de revisão pode fazer sentido econômico, desde que o custo por revisão seja justificado pela qualidade do que é entregue.

O Debate Maior: As Ferramentas de IA para Programação Estão Ficando Caras Demais?

A polêmica em torno do Claude Code Review não surgiu no vácuo. Ela faz parte de uma discussão mais ampla sobre os custos crescentes das ferramentas de inteligência artificial para desenvolvimento de software.

O investidor Chamath Palihapitiya, em um episódio recente do podcast All-In, compartilhou que sua startup de software, a 8090, está reconsiderando o uso do Cursor por causa do aumento dos custos. “Nossos custos mais que triplicaram desde novembro. Entre o custo de inferência que pagamos à AWS, que é gigantesco, e nossos custos com o Cursor e a Anthropic, estamos gastando milhões.”

Palihapitiya afirmou que a empresa está a caminho de gastar aproximadamente US$ 10 milhões por ano, equivalente a cerca de R$ 55 milhões pela cotação atual, apenas em custos de IA. “O problema é que meus custos estão triplicando a cada três meses. Minhas receitas, não”, disse ele.

É uma tensão que afeta startups de diferentes tamanhos: as ferramentas de IA aumentam a produtividade, mas o custo de escalar esse ganho de produtividade pode crescer mais rápido do que as receitas que ele gera.

O Que Ainda Falta para o Produto se Consolidar

O lançamento como research preview é, ao mesmo tempo, um convite e um alerta. Há inovação clara na abordagem, mas ainda não há estabilidade suficiente para prometer previsibilidade em todos os cenários.

Existem algumas limitações objetivas que merecem ser mencionadas. O Claude Code Review está disponível apenas para GitHub por enquanto, sem suporte para GitLab, Azure DevOps ou Bitbucket.

Também não está disponível para organizações com Retenção Zero de Dados ativada em seus contratos com a Anthropic.

A análise de segurança incluída é descrita como leve, e revisões mais profundas de vulnerabilidades dependem de um produto separado, o Claude Code Security.

A análise de segurança leve significa que a ferramenta identifica problemas óbvios de segurança durante a revisão, mas não substitui uma auditoria de segurança dedicada. Para isso, a Anthropic encaminha os clientes para o Claude Code Security, que é outro produto, com outro custo associado.

Para equipes que estão avaliando a adoção, a recomendação mais honesta é modelar o custo: estimar o volume mensal de pull requests, multiplicar pelo custo médio por revisão e comparar esse número com o tempo economizado e com os incidentes evitados.

Se o volume de PRs cresce junto com a adoção de IA, o gasto pode crescer de forma proporcional ou até mais rápida, o que exige políticas claras de uso.

O Que Isso Significa para o Desenvolvimento de Software

O lançamento do Claude Code Review é mais do que um novo produto de uma startup de IA. Ele é um indicador de como o ciclo de desenvolvimento de software está mudando de forma estrutural.

Com ferramentas como o Claude Code, o Codex, o Cursor e outras no mercado, os desenvolvedores estão entregando mais código do que nunca.

Mas isso também significa que mais código precisa ser revisado, e esse processo se tornou um gargalo significativo para muitas equipes.

A automação da revisão de código não é uma ideia nova. Linters, ferramentas de análise estática e sistemas de integração contínua já fazem parte do fluxo de trabalho de qualquer equipe moderna.

O que muda com o Claude Code Review é a profundidade da análise e a capacidade de identificar erros de lógica, não apenas de sintaxe, o que é uma fronteira que as ferramentas anteriores não conseguiam cruzar com consistência.

O debate sobre o impacto nos engenheiros seniores continuará. Mas talvez o ponto mais interessante seja outro: se a IA está escrevendo mais código e revisando mais código, o papel humano no desenvolvimento de software está se deslocando para camadas de mais alto nível, como a definição de arquitetura, a tomada de decisão sobre o que deve ser construído e a supervisão da qualidade dos sistemas de IA que trabalham junto com as equipes.

Isso não significa o fim dos engenheiros seniores. Significa, possivelmente, uma redefinição do que essa posição precisa representar.