A especulação de que a DeepSeek anunciaria seu novo modelo no Ano Novo Chinês não se concretizou. A startup de Hangzhou esperou até o dia 24 de abril de 2026 para apresentar o DeepSeek V4 ao mundo — e quando o fez, não foi apenas mais um lançamento de modelo de inteligência artificial. Foi um ato político e tecnológico ao mesmo tempo.

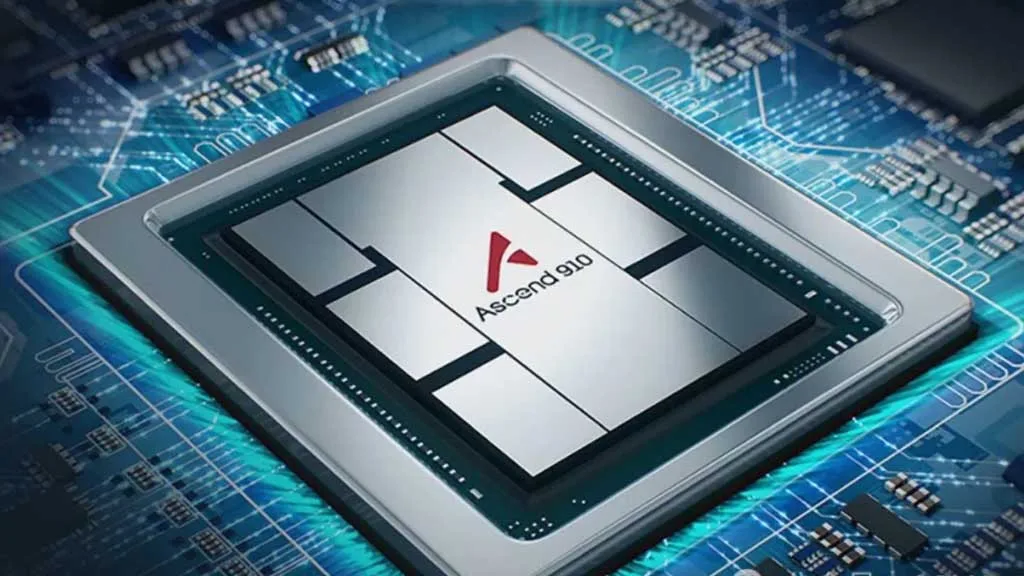

O novo modelo foi desenvolvido com suporte nativo aos chips Ascend da Huawei, empresa chinesa que passou anos sob sanções americanas severas. Segundo a Fortune, ao adaptar o V4 para funcionar na infraestrutura da Huawei, a DeepSeek sinaliza algo que pode mudar os rumos da corrida global pela Inteligência Artificial: um caminho independente das GPUs da Nvidia, hoje dominante no fornecimento de chips para IA em nível mundial.

Mais do que uma parceria comercial, o movimento representa uma declaração de intenções sobre onde a China quer estar na corrida global pela supremacia em inteligência artificial.

Mas o V4 não é apenas geopolítica. Tecnicamente, ele impressiona: 1,6 trilhão de parâmetros na versão Pro, janela de contexto de até 1 milhão de tokens e preços que chegam a ser 10 vezes menores do que os cobrados pela OpenAI, pelo GPT-5.4.

O lançamento aconteceu no mesmo dia em que o Departamento de Estado americano enviou um comunicado diplomático às embaixadas ao redor do mundo alertando sobre supostos roubos de propriedade intelectual por empresas chinesas de IA, e a DeepSeek estava explicitamente na lista.

O DeepSeek V4: Dois Modelos, Uma Estratégia

O DeepSeek V4 vem em duas versões com características e propósitos distintos, seguindo uma estratégia que a empresa já havia usado com o duo V3 e R1 no ano anterior.

V4-Pro: Potência Máxima

O V4-Pro é o carro-chefe. Com 1,6 trilhão de parâmetros totais, é o maior modelo que a DeepSeek já lançou. “Parâmetros” são os valores numéricos ajustáveis dentro de uma rede neural que determinam como o modelo interpreta e gera texto, quanto mais parâmetros, maior a capacidade teórica do modelo, embora outros fatores como arquitetura e dados de treinamento também pesem bastante.

A empresa afirma que o V4-Pro “demonstra desempenho superior em relação ao GPT-5.2 da OpenAI e ao Gemini-3.0-Pro do Google em testes de raciocínio padrão”, mas admite no próprio relatório técnico que o modelo “fica marginalmente atrás” das versões mais recentes como GPT-5.4 e Gemini 3.1 Pro, com uma diferença de “aproximadamente três a seis meses de desenvolvimento”.

Conforme documentado pelo Tom’s Hardware, o modelo supera todos os modelos de código aberto disponíveis no mercado em benchmarks de codificação com agentes de IA e raciocínio.

V4-Flash: Eficiência e Custo-Benefício

O V4-Flash tem 284 bilhões de parâmetros e é otimizado para ser mais rápido e barato de executar. Segundo a Teletime, especialistas do setor acreditam que o V4-Flash pode ter sido treinado principalmente nos chips Ascend da Huawei, enquanto o V4-Pro pode ter usado GPUs da Nvidia, embora a DeepSeek não tenha confirmado publicamente as configurações de hardware usadas no treinamento de cada versão. Ambos os modelos suportam inferência (o processo de gerar respostas) nos chips Ascend.

As Inovações Técnicas: Hybrid Attention, Mixture-of-Experts e 1 Milhão de Tokens

Por baixo dos números impressionantes, o DeepSeek V4 traz mudanças arquiteturais que explicam como a empresa consegue oferecer desempenho competitivo a preços muito menores que os concorrentes americanos.

Hybrid Attention Architecture

A principal inovação arquitetural do V4 é o que a DeepSeek chama de Hybrid Attention Architecture (Arquitetura de Atenção Híbrida).

O mecanismo de atenção é o componente fundamental dos modelos de linguagem que determina como cada palavra em um texto “presta atenção” às outras para entender o contexto. Na arquitetura tradicional, essa operação se torna exponencialmente mais cara à medida que o contexto cresce.

A arquitetura híbrida do V4 combina dois tipos de atenção: a quadrática (precisa, mas cara) para passagens críticas, e a linear (mais rápida e eficiente) para o restante. O resultado prático, conforme descrito no relatório técnico da empresa, é a capacidade de manter contextos muito mais longos sem um crescimento proporcional no custo computacional.

Mixture-of-Experts (MoE): Potência Seletiva

O V4 usa a técnica de Mixture-of-Experts (MoE), ou Mistura de Especialistas em português. Em vez de ativar todos os 1,6 trilhão de parâmetros para cada tarefa, o modelo ativa apenas um subconjunto relevante deles, os “especialistas” mais adequados para aquela pergunta específica.

O resultado é que, apesar do tamanho total enorme, o custo real de processamento por tarefa é muito menor do que os números absolutos sugerem.

Essa técnica é o principal responsável pelo diferencial de preço da DeepSeek. Como apenas uma fração dos parâmetros precisa ser carregada e executada para cada solicitação, o custo de inferência cai drasticamente, e a empresa repassa parte dessa economia ao consumidor.

Janela de Contexto de 1 Milhão de Tokens

Um token é a unidade básica que os modelos de linguagem usam para processar texto, aproximadamente equivalente a uma palavra curta em português. Uma janela de contexto de 1 milhão de tokens significa que o V4 consegue processar algo em torno de 750 mil palavras em uma única solicitação, equivalente a vários livros completos, uma base de código inteira ou documentos extensos de documentação técnica.

De acordo com a Startups.com.br, isso coloca o V4 no mesmo nível do Gemini da Google nesse aspecto específico, e abre caminho para aplicações corporativas que o processamento fragmentado simplesmente não consegue atender bem.

A Guerra de Preços: DeepSeek Contra o Mercado

Se a questão geopolítica é o que chama mais atenção nos noticiários, a questão dos preços é o que mais impacta diretamente desenvolvedores, empresas e o mercado de IA como um todo. A DeepSeek estabeleceu uma nova régua de referência no setor.

| Modelo | Empresa | Output / 1M tokens | Input / 1M tokens (cache miss) |

|---|---|---|---|

| GPT-5.4 | OpenAI (EUA) | US$ 30,00 (~R$ 176) | US$ 10,00 (~R$ 59) |

| Claude Opus 4.6 | Anthropic (EUA) | US$ 25,00 (~R$ 147) | US$ 15,00 (~R$ 88) |

| Kimi (Moonshot) | Moonshot AI (China) | US$ 4,00 (~R$ 23) | US$ 2,00 (~R$ 12) |

| DeepSeek V4-Pro | DeepSeek (China) | US$ 0,87 (~R$ 5,11) | US$ 0,435 (~R$ 2,55) |

| DeepSeek V4-Flash | DeepSeek (China) | US$ 0,28 (~R$ 1,64) | US$ 0,14 (~R$ 0,82) |

Conversões estimadas com base no câmbio (aproximadamente R$ 5,87 por dólar). Note que esses preços já refletem reduções significativas em relação ao lançamento inicial: conforme rastreado pelo Tom’s Hardware, os preços do V4 caíram continuamente desde o lançamento, o V4-Pro havia sido anunciado inicialmente por US$ 3,48 por milhão de tokens de output, mas a DeepSeek reduziu para US$ 0,87 em poucos dias, com promessa de novos cortes à medida que a Huawei escala a produção dos chips Ascend 950.

Para o mercado, essa estratégia de preços cria um dilema incômodo para as empresas americanas. Segundo a Fortune, enquanto OpenAI e Anthropic aumentaram preços e impuseram limites de taxa para gerenciar a demanda crescente, a DeepSeek vai na direção oposta, cortando preços agressivamente para ampliar a adoção.

As empresas chinesas concorrentes também sentiram o impacto: as ações da Zhipu AI e da MiniMax despencaram 9% no pregão seguinte ao lançamento do V4.

A Parceria com a Huawei: Muito Mais do que uma Questão de Hardware

A otimização do DeepSeek V4 para os chips Ascend da Huawei não é apenas uma escolha técnica. É uma escolha estratégica com implicações que vão muito além do desempenho computacional.

O Que São as NPUs Ascend da Huawei

A NPU (do inglês Neural Processing Unit, ou Unidade de Processamento Neural) é um tipo de chip projetado especificamente para executar as operações matemáticas que sustentam a inteligência artificial — multiplicações de matrizes em grande escala, principalmente.

É diferente de uma CPU (processador convencional), que é de uso geral, e de uma GPU (unidade de processamento gráfico), que foi adaptada para IA mas não foi projetada originalmente para isso.

Os chips Ascend da Huawei — especialmente o Ascend 950, mencionado diretamente pela DeepSeek — são o equivalente chinês às GPUs H100/A100 da Nvidia, que dominam o treinamento de modelos de IA em todo o mundo.

Conforme destacado pelo Jakarta Post, He Hui, diretor de pesquisa em semicondutores da consultoria Omdia, definiu o significado do lançamento com clareza: “Os chips Ascend da Huawei são a melhor alternativa doméstica chinesa à Nvidia, e o suporte ao DeepSeek V4 mostra que os principais modelos de IA chineses podem agora rodar em hardware chinês.”

“Os chips Ascend da Huawei são a melhor alternativa doméstica chinesa à Nvidia, e o suporte ao DeepSeek V4 mostra que os principais modelos de IA chineses podem agora rodar em hardware chinês.”He Hui, Diretora de Pesquisa em Semicondutores, Omdia — via The Jakarta Post, abril de 2026

Por Que a Parceria Interessa à China?

A Huawei tem uma história que torna essa parceria especialmente significativa. A empresa esteve no centro de uma das maiores tensões tecnológicas dos últimos anos quando, a partir de 2019, passou a ser alvo de sanções impostas pelos Estados Unidos sob alegações de riscos à segurança nacional — acusações que a companhia sempre negou.

As consequências foram profundas: os smartphones da Huawei passaram a ser vendidos sem os serviços do Google, incluindo Play Store, Gmail e YouTube. As restrições ao uso de chips avançados fabricados pela TSMC (Taiwan Semiconductor Manufacturing Company, a maior fundição de semicondutores do mundo) privaram a empresa de seus processadores Kirin mais modernos.

De acordo com a Startups.com.br, o período entre 2021 e 2022 foi marcado por uma queda expressiva nas vendas e no faturamento, encerrando um ciclo em que a Huawei chegou a disputar a liderança mundial no segmento de smartphones.

A resposta da Huawei foi investir pesadamente em desenvolvimento próprio. Em 2022, a empresa alocou cerca de CN¥ 161,5 bilhões (US$ 23,2 bilhões na cotação da época, aproximadamente R$ 136 bilhões) em pesquisa e desenvolvimento.

Entre os resultados: o sistema operacional HarmonyOS, soluções em nuvem proprietárias, diversificação para infraestrutura de redes e automobilismo inteligente.

A linha Mate 60, lançada em 2023 com chips desenvolvidos internamente em parceria com a SMIC (Semiconductor Manufacturing International Corporation, maior fundição de chips da China continental), marcou o início da retomada.

O Risco para a Nvidia

Conforme reportado pela Fortune, as ações da SMIC subiram 10% na bolsa de Hong Kong no dia do lançamento do V4 — diretamente impulsionadas pela notícia de que a Huawei (cujos chips Ascend são fabricados pela SMIC) estava integrada ao novo modelo da DeepSeek.

O movimento confirma as preocupações que o CEO da Nvidia, Jensen Huang, já havia expressado publicamente: a empresa americana corre o risco de perder seu ecossistema de desenvolvedores na China para alternativas domésticas, à medida que os controles de exportação americanos forçam o setor chinês a buscar soluções locais.

O Cenário Geopolítico: Acusações de IP e a Resposta Chinesa

O lançamento do V4 não poderia ter escolhido um dia mais tenso para acontecer. Em 24 de abril de 2026, o mesmo dia do anúncio da DeepSeek, a Reuters reportou que o Departamento de Estado americano havia enviado um cabo diplomático a embaixadas ao redor do mundo instruindo funcionários a alertar governos estrangeiros sobre “preocupações com a extração e destilação de modelos americanos por adversários” — com a DeepSeek, Moonshot AI e MiniMax explicitamente nomeadas.

Dois dias antes, o Escritório de Política Científica e Tecnológica da Casa Branca havia publicado um memorando acusando entidades chinesas de conduzir “campanhas deliberadas e em escala industrial para destilar modelos americanos de fronteira”. Michael Kratsios, principal assessor de ciência e tecnologia do presidente Donald Trump, havia feito afirmações semelhantes na rede social X.

A “destilação” a que se referem é um processo técnico em que um modelo de IA menor é treinado usando as saídas de um modelo maior e mais capaz, aprendendo a imitar seu comportamento sem ter acesso aos seus dados de treinamento ou pesos internos.

As acusações sugerem que a DeepSeek e outras empresas chinesas teriam usado respostas geradas por modelos americanos como Claude, GPT e Gemini para treinar suas próprias versões, violando os termos de uso desses serviços.

O Ministério das Relações Exteriores da China chamou as afirmações de “infundadas” e “uma difamação das conquistas da indústria de IA da China”. A DeepSeek não respondeu diretamente às acusações. E o V4 continua disponível globalmente, inclusive com acesso via API para desenvolvedores brasileiros.

A Trajetória da Huawei: de Ameaçada a Protagonista

2019

Governo americano inclui a Huawei na Entity List do Departamento de Comércio, restringindo seu acesso a fornecedores americanos de hardware e software. A empresa é obrigada a lançar smartphones sem os serviços do Google.

2020–2022

Queda expressiva nas vendas e faturamento da Huawei, especialmente em smartphones. A empresa acelera os investimentos em P&D (CN¥ 161,5 bilhões em 2022, equivalente a ~US$ 23,2 bilhões) e cria alternativas próprias: HarmonyOS, serviços de nuvem e soluções empresariais.

2023

Lançamento da linha Mate 60 com chips desenvolvidos em parceria com a SMIC. O retorno ao processamento avançado sem TSMC é visto como uma virada estratégica. As ações da Huawei sobem.

2024–2025

Huawei volta a crescer. Lança os chips Ascend 910C e 950 para IA em data centers, posicionando-se como alternativa às GPUs H100/A100 da Nvidia no mercado chinês.

Abril de 2026

DeepSeek lança o V4 com suporte nativo aos chips Ascend 950 da Huawei. A SMIC sobe 10% na bolsa de Hong Kong. A parceria é considerada o marco que comprova que modelos de IA de fronteira podem rodar em hardware 100% chinês.

Como Usar o DeepSeek V4 no Brasil

Como a DeepSeek segue uma estratégia de código aberto (do inglês, open source — quando o código-fonte de um software é disponibilizado publicamente para uso, modificação e distribuição), a versão preview do V4 pode ser acessada por desenvolvedores e empresas brasileiras através dos canais oficiais da companhia em api-docs.deepseek.com.

É importante ter em mente que, por estar em fase de “preview” (pré-lançamento, quando a versão ainda está sendo refinada com base no feedback real), o sistema pode passar por mudanças antes do lançamento final. A DeepSeek não forneceu uma data específica para a versão final.

⚠ Restrições de Conteúdo

Como qualquer modelo de IA operando sob a jurisdição chinesa, o DeepSeek V4 mantém restrições de resposta em temas politicamente sensíveis sob a ótica do governo da China. O modelo recusa, por exemplo, responder sobre o massacre da Praça da Paz Celestial de 1989 e outros assuntos censurados internamente na China. Empresas e desenvolvedores que precisam de respostas sobre esses temas devem considerar alternativas.

💡 Preços Para o Brasil (Estimativa)

Considerando o câmbio de referência de abril de 2026 (R$ 5,87 por dólar), o V4-Pro custa aproximadamente R$ 2,55 por 1 milhão de tokens de entrada e R$ 5,11 por 1 milhão de tokens de saída.

O V4-Flash sai por R$ 0,82 na entrada e R$ 1,64 na saída. Esses valores são na conversão direta; cobranças em reais podem variar conforme a taxa do dia e eventuais taxas de câmbio ou impostos aplicados pelo método de pagamento.

Perguntas sobre o DeepSeek V4

O que é o DeepSeek V4 e o que ele traz de novo em relação ao V3?

O DeepSeek V4 é o modelo de linguagem de grande porte mais recente da startup chinesa DeepSeek, lançado em preview no dia 24 de abril de 2026. As principais novidades em relação ao V3 são: arquitetura de atenção híbrida para contextos longos, janela de contexto de 1 milhão de tokens (contra 128 mil no V3), parâmetros totais de 1,6 trilhão no Pro (contra 671 bilhões no V3) e, pela primeira vez, suporte nativo e otimizado para chips de IA chineses da Huawei, em vez de depender exclusivamente de GPUs da Nvidia.

O que são parâmetros em um modelo de IA e por que 1,6 trilhão é relevante?

Parâmetros são os valores numéricos que uma rede neural ajusta durante o treinamento para aprender a reconhecer padrões e gerar respostas. Em termos simples, são como os “pesos” que determinam como o modelo pensa.

Mais parâmetros geralmente significam maior capacidade de lidar com tarefas complexas, embora a qualidade do treinamento e a arquitetura também importem muito. Com 1,6 trilhão, o V4-Pro está entre os maiores modelos disponíveis publicamente, para efeito de comparação, o GPT-3 da OpenAI tinha 175 bilhões, e o GPT-4 tem estimados 1,8 trilhão.

No V4, porém, apenas uma parte desses parâmetros é ativada por vez graças à técnica Mixture-of-Experts, o que mantém os custos de execução baixos.

O que é Mixture-of-Experts e por que ele torna o DeepSeek mais barato?

Mixture-of-Experts (MoE), ou Mistura de Especialistas, é uma arquitetura de rede neural em que o modelo é dividido em “especialistas” independentes. Para cada tarefa, um mecanismo de roteamento decide quais especialistas ativar, normalmente apenas uma pequena fração do total. Isso significa que, embora o modelo tenha 1,6 trilhão de parâmetros no total, na prática ele usa apenas alguns bilhões por consulta. O custo de inferência (processar respostas) cai significativamente, e a DeepSeek repassa parte dessa economia ao consumidor através de preços mais baixos.

Por que a parceria com a Huawei é importante estrategicamente?

Porque ela representa um passo concreto na redução da dependência chinesa das GPUs da Nvidia para desenvolvimento de IA. Os modelos de IA anteriores, incluindo o DeepSeek V3, foram treinados principalmente em GPUs Nvidia. Com o V4 otimizado para os chips Ascend da Huawei, a China demonstra que é possível treinar e executar modelos de fronteira em hardware 100% doméstico.

Para a Huawei, é a validação de anos de investimento em seus chips de IA após as sanções americanas. Para a China, é um passo no caminho para a soberania tecnológica em inteligência artificial.

O DeepSeek V4 realmente supera o GPT-5.4 da OpenAI?

Não de forma geral. O próprio relatório técnico da DeepSeek afirma que o V4-Pro “fica marginalmente atrás de GPT-5.4 e Gemini 3.1 Pro, sugerindo uma trajetória de desenvolvimento que está aproximadamente três a seis meses atrás dos modelos de fronteira do estado da arte”. Em benchmarks específicos de modelos de código aberto e em raciocínio padrão, o V4-Pro se compara favoravelmente.

Em testes independentes, os resultados tendem a variar bastante por tarefa. O ponto mais forte do V4 não é superar os melhores modelos fechados americanos, mas oferecer desempenho muito próximo a eles por uma fração do preço.

O que é um token em IA e o que significa ter 1 milhão de tokens de contexto?

Um token é a unidade básica de processamento de texto em modelos de linguagem. Cada token representa aproximadamente uma palavra curta ou parte de uma palavra longa em inglês — em português, a média é ligeiramente diferente. Uma janela de contexto de 1 milhão de tokens equivale a processar aproximadamente 750 mil palavras em inglês (ou algo similar em português) em uma única solicitação.

Na prática, isso significa que o modelo consegue analisar uma base de código inteira, um livro completo, um conjunto extenso de documentos ou uma conversa muito longa sem perder o fio da meada. Janelas de contexto maiores são especialmente úteis para aplicações empresariais complexas.

Um Lançamento com Dois Significados ao Mesmo Tempo

O DeepSeek V4 é, ao mesmo tempo, um produto tecnológico e um ato geopolítico. Como produto, ele entrega especificações impressionantes — especialmente a janela de contexto de 1 milhão de tokens e os preços que tornam o acesso à IA de fronteira acessível para desenvolvedores e empresas de qualquer porte.

Como ato geopolítico, ele é uma declaração de que a China não está mais apenas acompanhando os Estados Unidos na corrida por IA: está tentando estabelecer seu próprio ecossistema independente, do chip ao modelo.

A parceria com a Huawei é o elemento que transforma o lançamento em algo mais do que mais um modelo poderoso em um mercado lotado.

Conforme apontado pelo Jakarta Post, a DeepSeek ainda enfrenta dúvidas sobre o uso de chips Nvidia sob restrições comerciais para treinar modelos anteriores, a Anthropic acusa a empresa de ter usado o Claude de forma indevida para melhorar seus sistemas, e os benchmarks ainda precisam de validações independentes antes de serem tomados como definitivos.

Mas o sinal enviado pelo lançamento é claro. E as ações da SMIC, subindo 10% em Hong Kong no mesmo dia do anúncio, indicam que o mercado entendeu a mensagem.

Para desenvolvedores brasileiros: o DeepSeek V4 está disponível em preview via API em api-docs.deepseek.com. Com preços a partir de R$ 0,82 por 1 milhão de tokens de entrada no Flash, é uma das opções mais acessíveis do mercado para experimentos, protótipos e aplicações que tolerem as restrições de conteúdo do modelo. Para aplicações corporativas que exijam conformidade irrestrita, avalie as limitações de resposta em temas sensíveis antes de integrar.