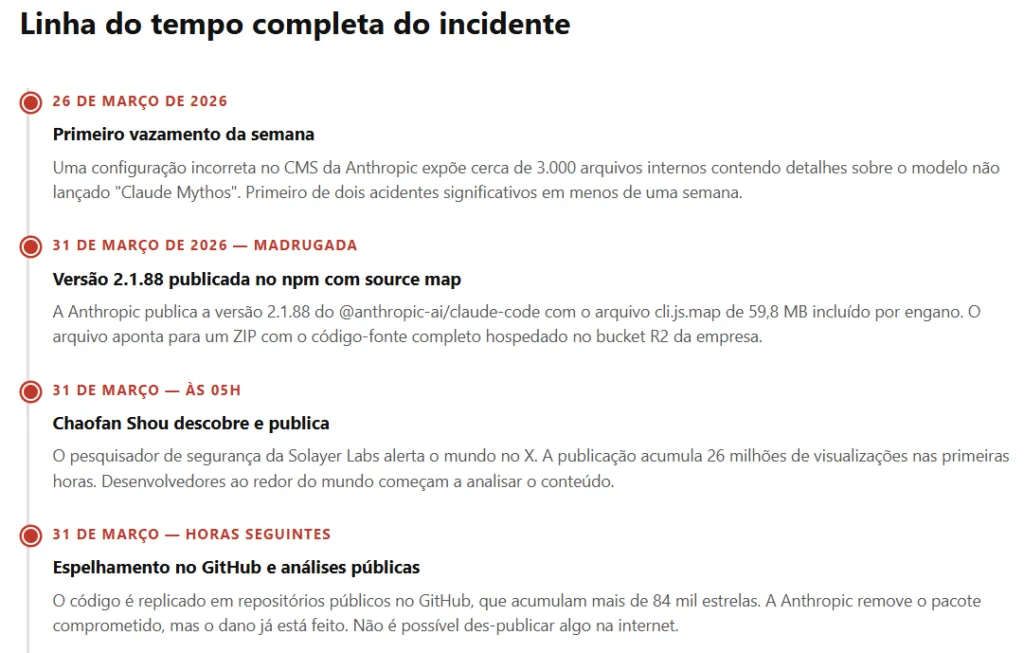

Às cinco da manhã do dia 31 de março de 2026, Chaofan Shou, pesquisador de segurança da Solayer Labs, publicou uma mensagem no X que chamaria a atenção de qualquer desenvolvedor que a visse: Vazamento do Claude Code com o código-fonte inteiro, a ferramenta de programação com inteligência artificial da Anthropic, estava disponível para download livre no registro público do npm.

Claude code source code has been leaked via a map file in their npm registry!

— Chaofan Shou (@Fried_rice) March 31, 2026

Code: https://t.co/jBiMoOzt8G pic.twitter.com/rYo5hbvEj8

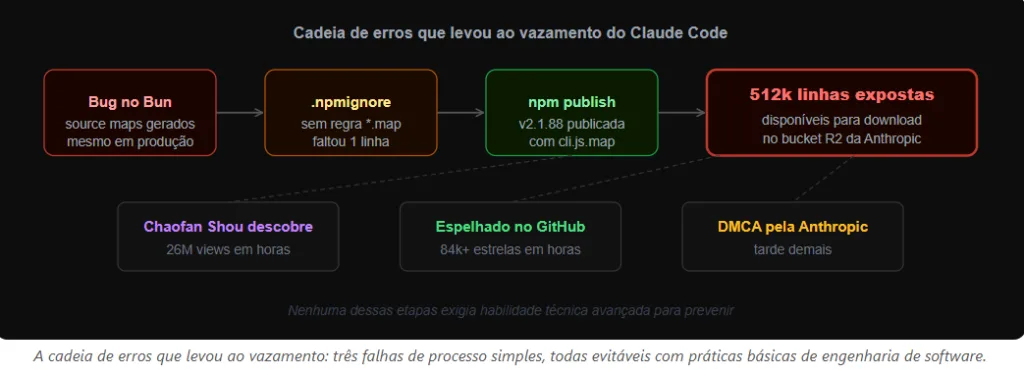

Nenhum invasor. Nenhum ataque sofisticado. Uma linha de configuração que faltou num arquivo de build foi o suficiente para expor 512 mil linhas de TypeScript, 1.900 arquivos internos e uma arquitetura que a empresa nunca planejou tornar pública.

Em poucas horas, a publicação no X tinha mais de 26 milhões de visualizações. O código já estava espelhado no GitHub e analisado por milhares de desenvolvedores ao redor do mundo, incluindo pesquisadores, competidores e jornalistas.

A Anthropic respondeu com a elegância corporativa padrão: “erro humano no processo de empacotamento de versão, não uma falha de segurança”. Tecnicamente correto. Mas o dano em termos de propriedade intelectual, reputação e revelação de detalhes internos já estava feito, e nenhuma remoção de pacote desfaz o que já foi publicado na internet.

Leia Também: FBI Confirma Invasão do E-mail Pessoal de Kash Patel pelo Grupo Handala, Ligado ao Irã

- Ver Ofertas

Como um Arquivo de 59,8 MB Expôs Tudo: a Cadeia de Erros

Para entender o vazamento, é preciso entender o que é um source map, ou “mapa de código-fonte” em português. Quando desenvolvedores constroem um software para produção, o código-fonte original, escrito de forma legível por humanos, passa por um processo de compactação e ofuscação chamado de “minificação”.

O resultado é um arquivo muito menor, mas incompreensível para qualquer pessoa que tente lê-lo. O source map é um arquivo separado que faz a correspondência entre o código minificado e o código original, como um dicionário que traduz um idioma cifrado de volta ao idioma compreensível.

Esse arquivo é indispensável durante o desenvolvimento e a depuração de problemas, mas jamais deve ser enviado junto com um pacote de software em produção. Por razões óbvias: ele essencialmente entrega o código-fonte completo.

O que é o npm? O npm (Node Package Manager, ou Gerenciador de Pacotes Node) é o repositório central de bibliotecas e ferramentas para JavaScript e TypeScript. É o equivalente ao que a App Store é para aplicativos de celular, mas para código de software.

Qualquer desenvolvedor pode publicar ou baixar pacotes de lá. O registro é público por padrão, o que significa que qualquer arquivo enviado junto com um pacote fica acessível para qualquer pessoa no mundo.

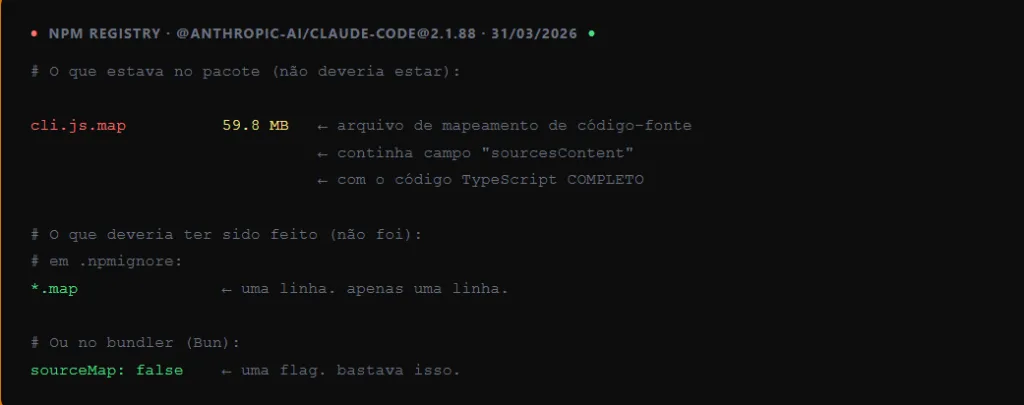

O Claude Code é compilado usando o Bun, um runtime JavaScript (ambiente de execução de código JavaScript) que a Anthropic adquiriu no final de 2024.

O Bun tinha um bug conhecido desde março de 2026: mesmo com as configurações de produção ativadas, ele continuava gerando source maps e os incluindo nos pacotes.

Bastava uma linha no arquivo de configuração chamado .npmignore para excluir esses arquivos da publicação. Essa linha nunca foi adicionada.

O resultado foi que a versão 2.1.88 do pacote oficial @anthropic-ai/claude-code chegou ao npm carregando um arquivo chamado cli.js.map com 59,8 MB de dados que apontavam diretamente para um arquivo ZIP no bucket de armazenamento em nuvem R2 da própria Anthropic, acessível publicamente sem qualquer autenticação.

O desenvolvedor e escritor Fábio Akita, que analisou o código vazado em detalhes em seu blog, resumiu bem a situação: bastava uma linha no arquivo de configuração para evitar o problema. Não foi feita. E o código que alimenta um dos produtos mais lucrativos da Anthropic, com receita anualizada de R$ 14,25 bilhões (US$ 2,5 bilhões) segundo dados da própria empresa, ficou à disposição de qualquer pessoa que soubesse onde olhar.

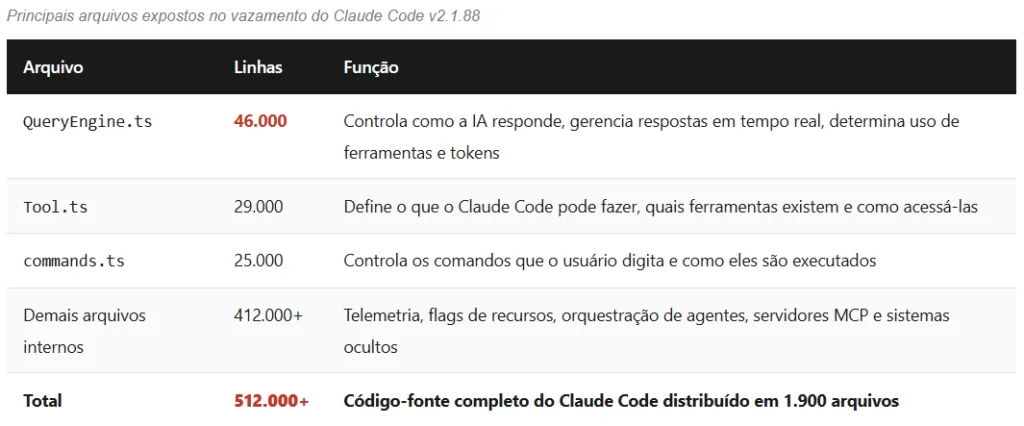

O que foi Exposto: Arquivos Críticos e a Arquitetura Interna Completa

O vazamento não expôs dados de usuários, senhas ou informações pessoais. O que foi revelado é algo diferente, e em alguns aspectos mais valioso do ponto de vista comercial: toda a lógica de funcionamento interno do produto.

A exposição afeta todos os subsistemas críticos da ferramenta. Com o código-fonte em mãos, pesquisadores de segurança, concorrentes e agentes mal-intencionados podem analisar como o produto filtra comandos, como decide o que é seguro executar no terminal do usuário e como se comunica com os servidores da Anthropic. Isso torna muito mais fácil criar tentativas de contornar as proteções internas do sistema.

As 44 Funções Secretas que o Vazamento Revelou

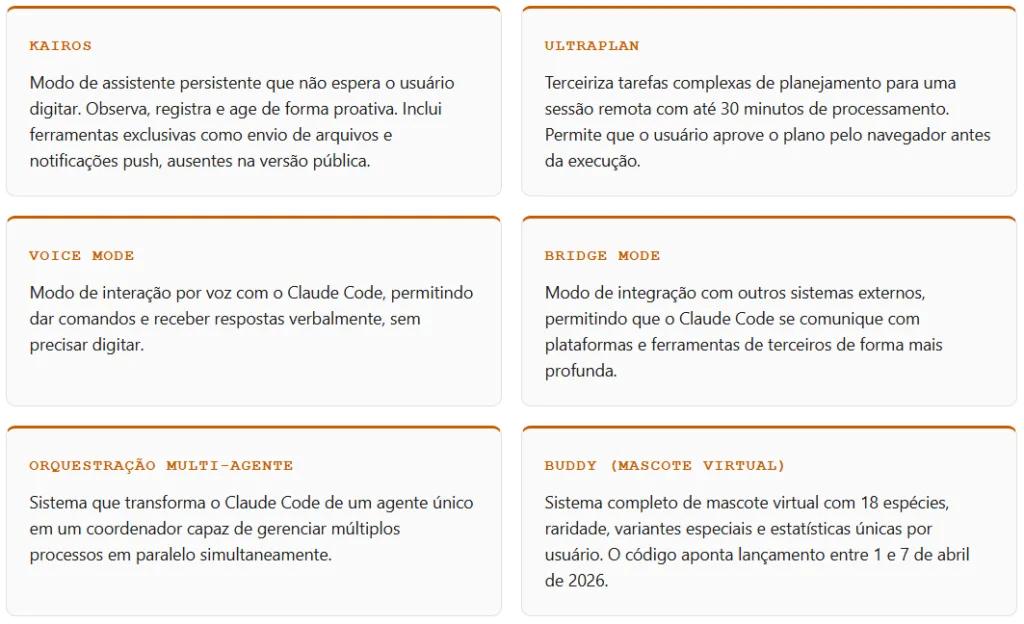

O aspecto mais comentado do incidente não foi o código que já existia publicamente, mas as funções ainda não lançadas descobertas escondidas dentro do código-fonte.

Segundo especialistas, o arquivo exposto revela 44 funções prontas mas desativadas nos produtos externos, aguardando um lançamento futuro. O desenvolvedor Fábio Akita destacou as mais impactantes em sua análise detalhada.

O vazamento também revelou referências a uma família de modelos chamada internamente de “Capybara”, ainda não anunciada publicamente. E confirma que a ferramenta diferencia dois tipos de usuários: funcionários da Anthropic (identificados internamente como USER_TYPE === ‘ant’) têm acesso a ferramentas extras, cabeçalhos beta exclusivos e a servidores de staging que os usuários externos simplesmente não enxergam.

O Undercover Mode: a IA Instruída a não Revelar que é IA

Entre todas as revelações do vazamento, nenhuma gerou mais debate do que o chamado Undercover Mode, ou “Modo Disfarce”. É um sistema de instruções que faz o Claude Code ocultar sua identidade e origem quando funcionários da Anthropic usam a ferramenta para contribuir com repositórios públicos de código aberto.

“O código injeta no sistema uma instrução direta: não mencione nomes internos de modelos, não cite números de versões não lançadas, não use a expressão ‘Claude Code’, não revele que você é uma IA.”Fábio Akita, em análise do código vazado publicada em seu blog — AkitaOnRails.com, 31/03/2026

O detalhe que mais incomodou especialistas em segurança e ética digital é que, segundo a análise de Akita, o modo não pode ser desligado manualmente. Se o sistema não tem certeza de que está operando num ambiente interno da empresa, ele mantém o disfarce ativo por padrão.

Isso levanta uma questão direta para qualquer pessoa que contribui com projetos de código aberto: pode estar interagindo com um agente de inteligência artificial instruído explicitamente a não se identificar como tal.

Em discussões de código, pull requests e issues de projetos open-source que afetam potencialmente milhões de usuários.

O que isso significa na prática: Comunidades de software de código aberto têm regras e expectativas sobre transparência. Quando alguém contribui para um projeto, outros desenvolvedores esperam saber com quem estão interagindo. Um agente de IA instruído a disfarçar sua natureza não viola apenas normas éticas informais, mas possivelmente os termos de serviço de plataformas como o GitHub, que proíbem automação não declarada em determinados contextos.

- Confira as Ofertas

Os Bugs Críticos e a Qualidade do Código que Ninguém Esperava Ver

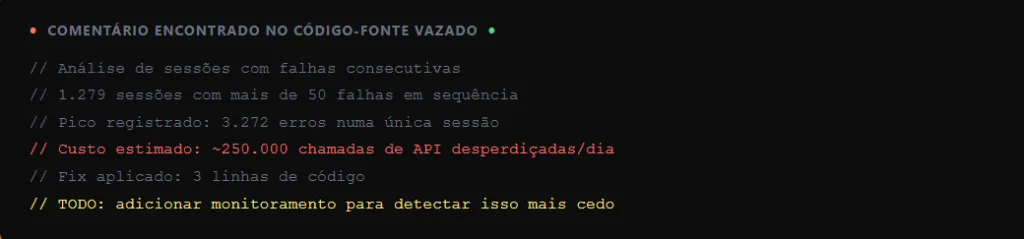

A análise do código vazado revelou não apenas funções secretas, mas também problemas técnicos sérios no produto já em uso.

O desenvolvedor Alex Volkov identificou bugs de cache que fazem chamadas de API sem cache custarem de 10 a 20 vezes mais do que as com cache, e reportou que mais de 500 usuários já registraram problemas de esgotamento de cota.

Se você sentiu que o Claude Code estava consumindo mais tokens do que o esperado, provavelmente não era impressão.

Mas o dado mais desconcertante veio do próprio código. Um comentário interno registra que 1.279 sessões acumularam mais de 50 falhas consecutivas numa única sessão, chegando em alguns casos a 3.272 erros, desperdiçando 250 mil chamadas de API por dia. O conserto para esse bug eram três linhas de código.

A análise mais comentada do vazamento foi a do desenvolvedor Kitze, que solicitou a outra inteligência artificial que avaliasse o código exposto. A nota foi 6,5 de 10. A descrição foi precisa e sem piedade: “não é código ruim de inexperiência. É código ruim de pressão para entregar rápido.”

Um único arquivo tem 803 mil bytes. Uma única função tem 3.167 linhas com doze níveis de estrutura aninhada, que é quando o código tem tantas camadas de condicionais e loops que a leitura se torna um pesadelo de manutenção. São os sinais clássicos de um produto construído em velocidade máxima, sem tempo para revisão.

O analista conhecido como iamfakeguru publicou como resposta prática um arquivo de configuração chamado CLAUDE.md que corrige alguns dos comportamentos problemáticos: força releitura de arquivos antes de edições, impõe verificação após cada alteração e instrui o sistema a trabalhar em partes quando o arquivo é grande demais. Para usuários que enfrentam problemas de qualidade com a ferramenta, essa configuração pode fazer diferença imediata.

Os Limites que a Anthropic não Documenta Publicamente

Para o usuário comum, o primeiro impacto prático do vazamento é entender que a ferramenta tem restrições técnicas que nunca foram comunicadas de forma clara na documentação oficial.

O Claude Code lê no máximo 2.000 linhas por vez ao abrir um arquivo. Se o arquivo tem mais do que isso, ele trunca o conteúdo silenciosamente e continua o trabalho como se tivesse lido tudo.

Se você pediu para ele analisar um arquivo grande e recebeu uma resposta que pareceu incompleta, era porque era. Os resultados de ferramentas internas também são cortados em 50.000 caracteres, sem aviso.

O sistema de compressão da janela de contexto descarta mensagens antigas automaticamente para abrir espaço para o contexto novo, o que pode fazer o agente “esquecer” partes de uma conversa longa sem informar o usuário.

E existe uma diferença clara entre o que funcionários da Anthropic veem e o que o público externo acessa, com ferramentas internas como ConfigTool e TungstenTool completamente invisíveis na versão pública.

Confira Também

O Ataque Paralelo ao Axios: Quando o Timing é Pior do que o Bug

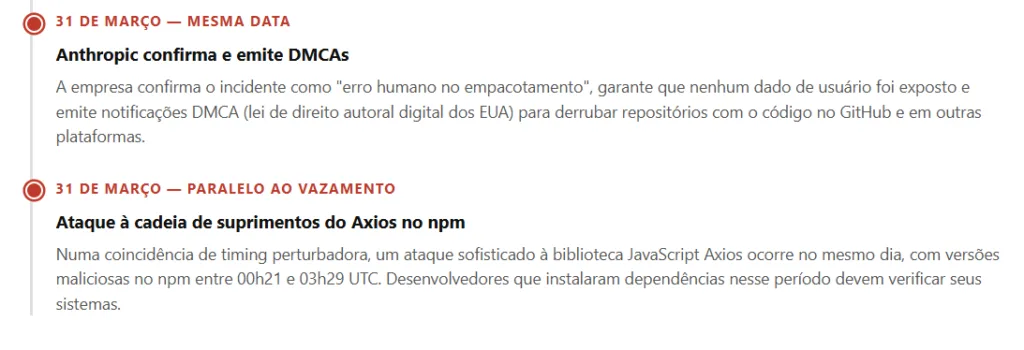

Por uma coincidência que tornou o dia 31 de março ainda mais caótico para a comunidade de desenvolvimento, um ataque sofisticado à biblioteca Axios ocorreu no mesmo dia do vazamento da Anthropic.

O Axios é uma das bibliotecas JavaScript mais usadas do mundo, com cerca de 100 milhões de downloads semanais. Ele permite que aplicações web e mobile se comuniquem com servidores e APIs.

Atacantes comprometeram a conta npm do mantenedor principal da biblioteca, trocaram o endereço de e-mail cadastrado e usaram um token de acesso de longa duração para publicar versões maliciosas.

As versões 1.14.1 e 0.30.4 do Axios chegaram ao npm entre 00h21 e 03h29 UTC, ficando no ar por menos de três horas antes de serem removidas. Três horas suficientes para expor uma quantidade enorme de projetos.

O mecanismo do ataque era elegante e perturbador: as versões maliciosas não modificavam o código do Axios em si. A única alteração estava no arquivo package.json, que adicionava uma dependência nova e suspeita chamada plain-crypto-js, criada pelo próprio atacante.

Quando o npm instala um pacote, instala automaticamente todas as suas dependências, sem pedir confirmação adicional. O plain-crypto-js continha um script que, ao ser instalado, baixava silenciosamente um malware do servidor dos atacantes e o executava em segundo plano, sem exibir nenhum aviso ao desenvolvedor.

O que fazer se você instalou o Axios em 31/03/2026: Verifique se seus arquivos de lockfile (package-lock.json, yarn.lock, pnpm-lock.yaml) contêm as versões axios@1.14.1, axios@0.30.4 ou plain-crypto-js@4.2.1. Se qualquer uma dessas versões aparecer, o ambiente foi exposto.

Em sistemas potencialmente comprometidos, busque os arquivos /Library/Caches/com.apple.act.mond (macOS), wt.exe na pasta ProgramData (Windows) ou /tmp/ld.py (Linux). Rotacione imediatamente todos os tokens, chaves de API e credenciais que estavam acessíveis no momento da instalação.

A Anthropic e o IPO de R$ 342 Bilhões

Enquanto o vazamento dominava as conversas técnicas, outra notícia circulava nos bastidores financeiros do setor.

Segundo o The Information, a Anthropic está em conversas com bancos para uma abertura de capital que pode ocorrer já no quarto trimestre de 2026.

A meta de captação está acima de US$ 60 bilhões (aproximadamente R$ 342 bilhões), e a receita anualizada da empresa chegou a US$ 19 bilhões, puxada pelo crescimento da API e das assinaturas do Claude.

Dois vazamentos significativos em menos de uma semana, incluindo a exposição de toda a arquitetura interna do produto mais lucrativo da empresa, não é o tipo de notícia que investidores esperam numa fase de preparação para IPO.

A Anthropic se posiciona publicamente como uma empresa focada em segurança de IA responsável. A revelação de um Undercover Mode que instrui a ferramenta a disfarçar sua natureza coloca tensão direta nesse posicionamento.

Além disso, o vazamento não foi o primeiro desse tipo. Um incidente quase idêntico ocorreu em fevereiro de 2025, também por falha num arquivo de source map.

A mesma empresa, o mesmo mecanismo de erro, treze meses depois. Isso levanta uma questão sobre disciplina de processo que qualquer analista de mercado fará antes de recomendar a ação.

“Dois vazamentos acidentais significativos em menos de uma semana levantam questões sobre a higiene de lançamento em uma empresa cujas ferramentas são ativamente utilizadas para escrever e distribuir código em escala.”Bitcoin News, análise do incidente — Bitcoin News, 31/03/2026

Um IPO muda as regras do jogo. Acionistas públicos têm expectativas diferentes de investidores de risco: querem crescimento, mas também querem previsibilidade, margens e uma história que caiba num relatório trimestral.

A Anthropic precisará convencer o mercado de que consegue crescer na velocidade que os números sugerem sem perder a disciplina operacional que uma empresa pública exige.