Fevereiro de 2026 vai entrar para a história como o mês em que o setor de inteligência artificial se viu obrigado a responder a uma pergunta que muita gente preferia adiar: até onde vai a responsabilidade de uma empresa de tecnologia quando o seu produto está rodando dentro de redes militares?

A Anthropic, criadora do assistente de IA Claude e uma das empresas mais valiosas do mundo atualmente, está no centro de um conflito que mistura tecnologia, ética, segurança nacional e política americana.

De um lado, o CEO Dario Amodei defendendo linhas que ele considera inegociáveis. Do outro, o Secretário de Defesa Pete Hegseth ameaçando rasgar um contrato de 200 milhões de dólares e ainda colocar a empresa numa lista de “risco à cadeia de suprimentos” normalmente reservada a adversários estrangeiros.

Isso não é um desentendimento burocrático. É uma colisão filosófica entre duas visões radicalmente diferentes sobre o que a inteligência artificial deveria fazer dentro do aparato militar de um Estado.

O que é a Anthropic e por que ela chegou ao centro dessa crise

Para entender o conflito, é preciso entender quem é a Anthropic. A empresa foi fundada em 2021 por ex-executivos da OpenAI que acreditavam que a indústria não estava levando a sério os riscos de segurança da inteligência artificial. Dario Amodei, o CEO, e sua irmã Daniela Amodei, a presidenta, saíram da OpenAI justamente com a proposta de construir uma alternativa mais cautelosa, mais ética.

O nome interno do projeto reflete isso: a Anthropic se posiciona como uma empresa de “segurança em primeiro lugar” (do inglês “safety first”), com o Claude sendo vendido como o modelo mais responsável entre os gigantes do setor.

Essa reputação, curiosamente, foi o que a colocou dentro do Pentágono antes de qualquer concorrente. No verão de 2024, o Departamento de Defesa dos Estados Unidos concedeu contratos de até 200 milhões de dólares cada para quatro empresas: Anthropic, Google, OpenAI e xAI (a empresa de Elon Musk). Mas foi a Anthropic a primeira a ter seu sistema aprovado para uso em ambientes que contêm informações secretas do governo americano. As autoridades de Defesa avaliaram o Claude como o modelo mais avançado e seguro para aplicações sensíveis.

A ironia não poderia ser maior: a empresa que mais insistia em segurança foi a que entrou mais fundo no aparato de segurança nacional.

O Claude em redes de inteligência militar: uma parceria com a Palantir

No final de 2024, a Anthropic formalizou uma parceria com a Palantir, uma empresa de análise de dados e inteligência artificial voltada para governo e defesa. Por meio dessa parceria, o Claude passou a operar em plataformas com nível de segurança de até “secreto” (em inglês, “secret”), tornando-se, segundo registros públicos, o primeiro grande modelo de linguagem a funcionar dentro de redes de informações sensíveis militares norte-americanas.

Um modelo de linguagem de grande escala, ou LLM (sigla para “Large Language Model” em inglês), é um tipo de inteligência artificial treinado com enormes volumes de texto que aprende a gerar, resumir e analisar linguagem com alto grau de sofisticação.

O Claude, nesse contexto, passou a ter acesso a capacidades que vão muito além do chatbot convencional: os modelos mais recentes da Anthropic conseguem controlar computadores, navegar em aplicativos web, preencher formulários com capacidade equivalente à humana e coordenar equipes de agentes autônomos trabalhando em paralelo.

Agentes autônomos são sistemas de inteligência artificial que operam de forma independente para completar tarefas complexas, dividindo o trabalho e tomando decisões com mínima supervisão humana. É uma tecnologia poderosa para empresas que querem automatizar processos. Mas dentro de uma rede militar secreta, o potencial, e os riscos, são de outra dimensão.

A operação na Venezuela e o ponto de ruptura

A tensão que já existia entre a Anthropic e o Pentágono explodiu em janeiro de 2026 depois de um episódio específico. Em 3 de janeiro, forças especiais dos Estados Unidos conduziram uma operação na Venezuela e capturaram o ditador Nicolás Maduro. O jornal Wall Street Journal reportou que durante a operação as forças americanas utilizaram o Claude, por meio da parceria da Anthropic com a Palantir.

Quando um executivo da Anthropic entrou em contato com a Palantir para perguntar se o sistema havia sido usado na operação, o gesto disparou alarmes imediatos dentro do Pentágono. A empresa afirmou depois que a pergunta não tinha a intenção de sinalizar desaprovação da operação específica, mas o estrago já estava feito. A percepção que ficou entre os militares foi de que a Anthropic estava monitorando ou questionando como sua tecnologia era usada em campo, e isso foi interpretado como interferência.

A partir desse momento, as negociações que já eram difíceis se tornaram abertamente hostis. Um alto funcionário da administração Trump disse ao Axios que o Secretário Hegseth estava “perto” de encerrar a relação com a Anthropic, acrescentando: “Vamos garantir que eles paguem um preço por nos forçar assim.”

Hegseth e Dario Amodei frente a frente

Em 24 de fevereiro de 2026, Hegseth e Dario Amodei se encontraram pessoalmente no Pentágono. Segundo uma pessoa com conhecimento direto da reunião que não estava autorizada a falar publicamente, Hegseth deixou claro: ou a Anthropic concorda em afrouxar seus padrões de segurança até sexta-feira, ou o contrato de 200 milhões de dólares seria cancelado.

Amodei não recuou. Ele reiterou as duas posições que já havia defendido publicamente: a Anthropic não vai permitir que o Claude seja usado para vigilância doméstica em massa de americanos, e não vai permitir que ele seja usado em sistemas de armas totalmente autônomas. Essas são, nas palavras do próprio Dario Amodei em ensaio publicado em seu site pessoal, linhas que cruzá-las tornaria os Estados Unidos “mais parecidos com os adversários autocráticos que querem combater.”

Hegseth rebateu com uma linguagem bem diferente. Segundo a fonte citada pela NPR, o Secretário de Defesa afirmou que os Estados Unidos precisam poder usar a inteligência artificial para todos os propósitos “legais” (“lawful”, no original em inglês), o que poderia incluir guerra conduzida por IA e vigilância. Chamou as restrições da Anthropic de “woke AI”, um termo que os funcionários da administração Trump têm usado para descrever qualquer proteção de segurança em ferramentas de IA ou a percepção de que os chatbots têm viés político liberal incorporado.

Pesquisadores de IA afirmam que “woke AI” é um rótulo vago e mal definido, mas que tem sido eficaz politicamente para pressionar empresas de tecnologia a relaxar salvaguardas.

As duas linhas vermelhas da Anthropic

Para entender por que a Anthropic está se recusando a ceder, é preciso olhar com mais detalhe para o que essas duas restrições realmente significam e por que elas são tão difíceis de aplicar na prática.

Quando análise de dados vira espionagem

A primeira linha vermelha da Anthropic proíbe o uso do Claude para vigilância doméstica em massa de cidadãos americanos. Na superfície, parece simples. Na prática, é onde as coisas ficam complicadas de uma forma que nenhum advogado consegue resolver rapidamente.

Emelia Probasco, pesquisadora sênior do Centro de Segurança e Tecnologia Emergente da Universidade de Georgetown, coloca o problema assim: “Essas palavras parecem simples: vigilância ilegal de americanos. Mas quando você aprofunda, há exércitos inteiros de advogados tentando interpretar essa frase.”

O precedente histórico é revelador. Após as revelações de Edward Snowden em 2013, o governo americano defendeu a coleta em massa de metadados telefônicos, ou seja, quem ligou para quem, quando e por quanto tempo, argumentando que esse tipo de dado não tinha as mesmas proteções de privacidade que o conteúdo de conversas.

O debate de privacidade de então era sobre analistas humanos pesquisando esses registros. Agora imagine um sistema de IA consultando conjuntos de dados vastos, mapeando redes de contatos, identificando padrões de comportamento, sinalizando pessoas de interesse. A estrutura legal que existe foi construída para uma era de revisão humana, não de análise em escala de máquina.

Peter Asaro, cofundador do Comitê Internacional para Controle de Armas Robóticas, é mais direto em sua avaliação: “Em certo sentido, qualquer tipo de coleta de dados em massa que você pede a uma IA para analisar é vigilância em massa por definição simples.”

Ele enxerga duas leituras possíveis para a posição do Pentágono de que as restrições da Anthropic criam uma “zona cinzenta inviável”. A interpretação generosa é que vigilância realmente é impossível de definir na era da IA. A interpretação pessimista é que “eles realmente querem usar isso para vigilância em massa e armas autônomas e não querem admitir isso, então chamam de zona cinzenta.”

Armas autônomas: onde a linha pode ser mais clara, mas não muito

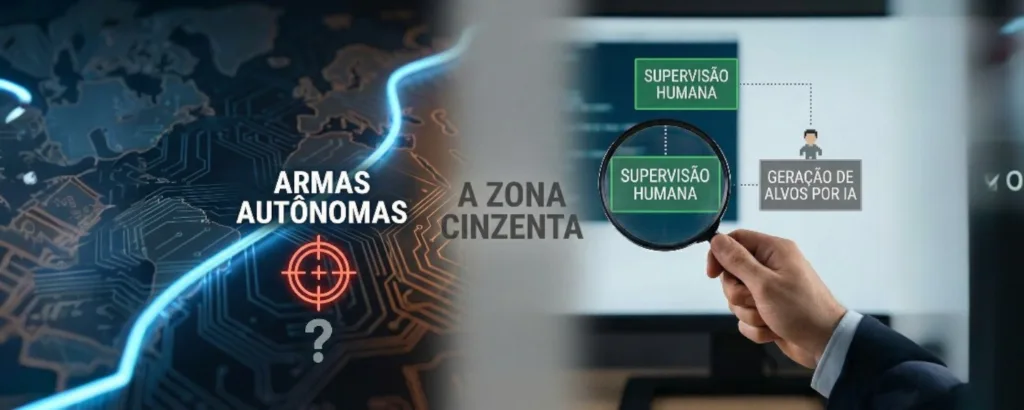

A segunda restrição da Anthropic proíbe sistemas que selecionem e ataquem alvos sem supervisão humana. Tecnicamente, a definição de armas autônomas é mais estreita do que a de vigilância, o que poderia torná-la mais gerenciável. Mas Asaro aponta para uma zona cinzenta igualmente preocupante.

Ele menciona os sistemas israelenses Lavender e Gospel, que foram reportados como usando inteligência artificial para gerar listas massivas de alvos que depois vão para um operador humano aprovar antes que os ataques sejam executados. Automatizou essencialmente o elemento de seleção de alvos, que é algo extremamente preocupante e intimamente relacionado com o problema das armas autônomas, mesmo que caia fora da definição estrita e técnica do termo.

A pergunta que ninguém na Anthropic consegue responder com certeza é se o Claude, operando dentro dos sistemas da Palantir, poderia estar fazendo algo similar: processando inteligência, identificando padrões, sinalizando pessoas de interesse, sem que alguém na empresa conseguisse dizer precisamente onde o trabalho analítico termina e onde o direcionamento de alvos começa.

A operação em que Maduro foi capturado testa exatamente essa distinção. “Se você está coletando dados e inteligência para identificar alvos, mas humanos estão decidindo ‘Ok, esta é a lista de alvos que vamos bombardear’, então você tem aquele nível de supervisão humana que estamos tentando exigir,” diz Asaro. “Por outro lado, você ainda está se tornando dependente dessas IAs para escolher esses alvos, e quanto de verificação e quanto de investigação sobre a validade ou legalidade desses alvos é uma questão separada.”

Leia Também

Novas capacidades que tornam a questão mais urgente

O timing desse conflito não é acidental. Em 5 de fevereiro de 2026, a Anthropic lançou o Claude Opus 4.6, seu modelo mais poderoso até então. Entre as novidades está a capacidade de coordenar equipes de agentes autônomos, múltiplas IAs que dividem o trabalho e o completam em paralelo. Doze dias depois, a empresa lançou o Sonnet 4.6, um modelo mais barato que quase iguala as capacidades do Opus em codificação e controle de computadores. Ambos têm uma memória de trabalho grande o suficiente para comportar uma pequena biblioteca de documentos.

Essas são exatamente as capacidades que tornam o Claude tão atraente em inteligência militar. Um modelo com memória de trabalho expandida pode conter um dossiê de inteligência completo. Um sistema que consegue coordenar agentes autônomos para depurar uma base de código pode coordená-los para mapear uma cadeia de suprimentos insurgente. Quanto mais capaz o Claude se torna, mais fina fica a linha entre o trabalho analítico de rotina que a Anthropic está disposta a apoiar e a vigilância e o direcionamento de alvos que ela prometeu recusar.

Probasco, de Georgetown, teme que o confronto com o Pentágono crie uma falsa dicotomia. “E se a gente tiver segurança e segurança nacional ao mesmo tempo?”, ela pergunta. A provocação é válida: a sugestão implícita nas exigências do Pentágono é que essas duas coisas são mutuamente excludentes, quando poderiam não ser.

O contexto competitivo: o que as outras empresas estão fazendo

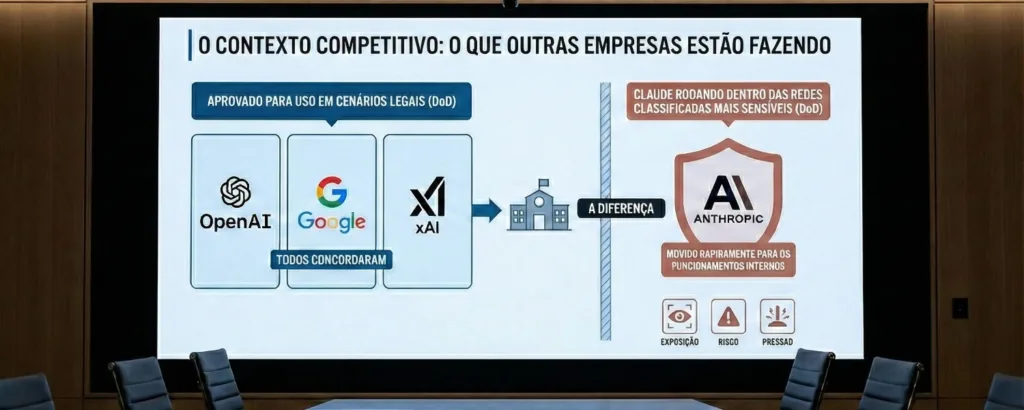

A posição da Anthropic fica ainda mais saliente quando você olha para o que seus concorrentes estão fazendo. OpenAI, Google e a xAI de Elon Musk concordaram em deixar suas ferramentas de IA serem usadas em qualquer cenário “legal” para o Departamento de Defesa. A xAI inclusive teve seu sistema aprovado para uso em ambientes militares na mesma semana do encontro entre Hegseth e Amodei.

A diferença é que os modelos dos concorrentes ainda não estão rodando dentro sistemas mais sensíveis do governo americano, ao contrário do Claude. O Pentágono contratou as quatro empresas com valores de até 200 milhões de dólares cada no verão de 2024, mas foi a Anthropic que avançou mais rapidamente para o interior do aparato de inteligência militar. Ironicamente, isso deu à empresa mais exposição, mais risco e, agora, mais pressão para abandonar os princípios que a tornaram atraente em primeiro lugar.

As ferramentas de pressão do Governo: da Lei de Produção de Defesa ao rótulo de “risco à cadeia de suprimentos”

O que torna esse conflito particularmente sério é o arsenal de pressão que o governo americano tem disponível. Segundo a NPR, Hegseth mencionou durante a reunião duas opções caso a Anthropic continue recusando as exigências.

A primeira é invocar a Lei de Produção de Defesa (Defense Production Act, em inglês), uma lei dos anos 1950 normalmente acionada durante emergências nacionais para forçar empresas a produzir determinados produtos considerados críticos para a segurança nacional. Usá-la contra uma empresa de tecnologia por discordâncias sobre política de uso seria uma aplicação inédita e controversa da lei.

A segunda é rotular a Anthropic como “risco à cadeia de suprimentos” (supply chain risk, no original). Esse rótulo é normalmente associado a adversários estrangeiros e poderia efetivamente forçar contratantes do Pentágono a remover o Claude de trabalhos sensíveis. Para uma empresa cuja estratégia comercial depende cada vez mais do setor governamental e de grandes clientes corporativos, essa designação poderia ser devastadora.

O Departamento de Defesa não respondeu aos pedidos de comentário sobre o assunto.

O que está em jogo para além do contrato

Reduzir este conflito a uma disputa contratual de 200 milhões de dólares seria perder o ponto mais importante. O que está sendo testado aqui é algo bem maior: se empresas de tecnologia privadas podem, ou devem, estabelecer limites éticos para como seus produtos são usados por governos, mesmo quando esses governos são clientes pagantes e aliados políticos.

A Anthropic foi fundada sobre a premissa de que o desenvolvimento de inteligência artificial precisa ser guiado por considerações de segurança e ética desde o início, não como uma camada adicionada depois que os sistemas já estão implantados.

Os fundadores saíram da OpenAI justamente porque acreditavam que a velocidade de desenvolvimento estava superando as salvaguardas necessárias. Agora essa mesma aposta está sendo testada no contexto mais difícil possível: dentro do aparato de segurança nacional de uma superpotência, com ameaças legais e financeiras reais na mesa.

A empresa fechou uma rodada de financiamento de 30 bilhões de dólares na semana do conflito, com avaliação de 380 bilhões de dólares. Clientes corporativos representam cerca de 80% da receita da Anthropic. A empresa tem escala e recursos para suportar a pressão no curto prazo. Mas a questão que permanece é se a identidade de “segurança primeiro” é um princípio de fundação ou um argumento de marketing que evaporará na primeira grande crise.

A pergunta que não tem resposta fácil

O confronto entre a Anthropic e o Pentágono levanta uma questão que o setor de tecnologia vai ter que responder de uma forma ou de outra nos próximos anos. Quando uma IA suficientemente poderosa está operando dentro de sistemas militares, quem define os limites do que ela pode fazer?

Se a resposta for “o governo decide tudo”, então empresas como a Anthropic se tornam essencialmente fornecedoras de capacidade computacional sem autonomia ética real. Se a resposta for “a empresa decide tudo”, então você tem organizações privadas, não eleitas e não responsabilizadas democraticamente, definindo regras de guerra para as maiores potências do mundo.

Nenhuma dessas respostas é satisfatória. E nenhum conjunto de advogados vai resolver isso antes que a tecnologia avance ainda mais. O que o conflito de fevereiro de 2026 deixa claro é que a questão chegou, é urgente, e os atores envolvidos estão muito longe de um acordo.

Probasco, de Georgetown, resume a questão com uma clareza que deveria incomodar todo mundo que acompanha o setor: a ideia de que segurança e segurança nacional são opostos é uma falsa escolha. “Como sobre a gente ter segurança e segurança nacional?”, ela pergunta. É exatamente o tipo de pergunta que ninguém no Pentágono ou na Anthropic consegue responder sem que a outra parte sinta que está perdendo algo fundamental.

E é exatamente por isso que essa história estava longe de ter um final, até que ele chegou de forma abrupta e definitiva em 27 de fevereiro de 2026.

Atualização: o desfecho que ninguém queria, mas todos esperavam

27 de fevereiro de 2026. O prazo que Pete Hegseth havia fixado para as 17h01 dessa sexta-feira passou, e a Anthropic não cedeu. Em questão de horas, a disputa que durava semanas saiu do campo das negociações e entrou para a história da tecnologia.

Trump bane a Anthropic do governo dos Estados Unidos

O presidente Donald Trump publicou um post na plataforma Truth Social ordenando que todas as agências federais encerrassem o uso de produtos da Anthropic.

O governo concedeu um prazo de seis meses para que os departamentos realizem a transição e deixem de utilizar o Claude em suas operações. No mesmo post, Trump deixou um recado para a empresa: “Os malucos de esquerda da Anthropic cometeram um ERRO DESASTROSO tentando PRESSIONAR o Departamento de Guerra e forçá-los a obedecer seus Termos de Serviço em vez da nossa Constituição.”

Trump ainda acrescentou que, caso a Anthropic não colaborasse com o período de transição, utilizaria o “pleno poder da presidência” para forçar o cumprimento, com possíveis consequências civis e criminais.

Hegseth cumpre a ameaça: Anthropic vira “Risco à Cadeia de Suprimentos”

Logo após o anúncio de Trump, o Secretário de Defesa Pete Hegseth foi às redes sociais confirmar que o Pentágono estava oficialmente designando a Anthropic como um risco à cadeia de suprimentos, a mesma categoria geralmente reservada para adversários estrangeiros como empresas chinesas suspeitas de espionagem. Com essa designação, todos os contratantes de defesa ficam proibidos de usar a tecnologia da empresa. “Os combatentes da América nunca serão reféns dos caprichos ideológicos das grandes empresas de tecnologia”, disse Hegseth. “Esta decisão é final.”

A Anthropic, por sua vez, informou à imprensa que durante as negociações a última versão do contrato apresentada pelo Pentágono não garantia de forma plena que a tecnologia não seria usada para os dois casos que a empresa considera inaceitáveis: armas totalmente autônomas e vigilância doméstica em massa.

OpenAI surpreende: mesmas linhas vermelhas

Um dos desdobramentos mais inesperados do desfecho veio de uma concorrente. Na sexta-feira, a OpenAI declarou ter as mesmas “linhas vermelhas” que a Anthropic em relação ao uso de sua tecnologia pelo Pentágono. “Há muito tempo acreditamos que a IA não deve ser usada para vigilância em massa ou armas letais autônomas, e que humanos devem permanecer no circuito para decisões automatizadas de alto risco”, escreveu o CEO Sam Altman em um comunicado interno visto pela CNBC.

Vale notar que o contrato da OpenAI com o Departamento de Defesa é para casos de uso não secretos, como tarefas comuns de escritório, enquanto o da Anthropic envolvia trabalho confidencial.

O Congresso tenta mediar

Antes do prazo expirar, membros seniores do Comitê de Forças Armadas do Senado enviaram uma carta privada tanto à Anthropic quanto ao Pentágono pedindo que as negociações fossem estendidas. Na carta, os senadores afirmaram endossar as posições do Pentágono de que não pretende conduzir vigilância em massa nem usar armas autônomas sem humanos no circuito, mas reconheceram que as restrições da Anthropic, se mantidas, poderiam comprometer operações militares. A tentativa de mediação não foi suficiente para evitar o rompimento.

O que muda agora

O impacto imediato é claro: o Claude deixa de operar em redes de inteligência militares americanas, e a Anthropic perde seu contrato governamental de até 200 milhões de dólares. Mas as consequências de longo prazo são mais difíceis de calcular. A empresa segue com uma avaliação de mercado de 380 bilhões de dólares e com clientes corporativos respondendo por cerca de 80% de sua receita, o que significa que o golpe financeiro imediato pode ser absorvido.

O que não se absorve tão facilmente é o precedente. Uma empresa privada se recusou a atender às exigências do governo mais poderoso do mundo sobre como sua tecnologia pode ser usada em contextos militares, e foi punida por isso com o maior instrumento de pressão disponível fora de uma ação judicial. O debate sobre quem define os limites éticos da inteligência artificial em tempo de guerra acaba de ganhar sua primeira decisão concreta, e ela não foi tomada em tribunal nem em comissão parlamentar. Foi tomada numa postagem em rede social.